Slik hindrer du at Snapchat trener på dine innlegg

For sikkerhets skyld bør du si nei til at KI-selskaper lar sine kunstige intelligenser trene seg opp på dine tekster, bilder og meldinger.

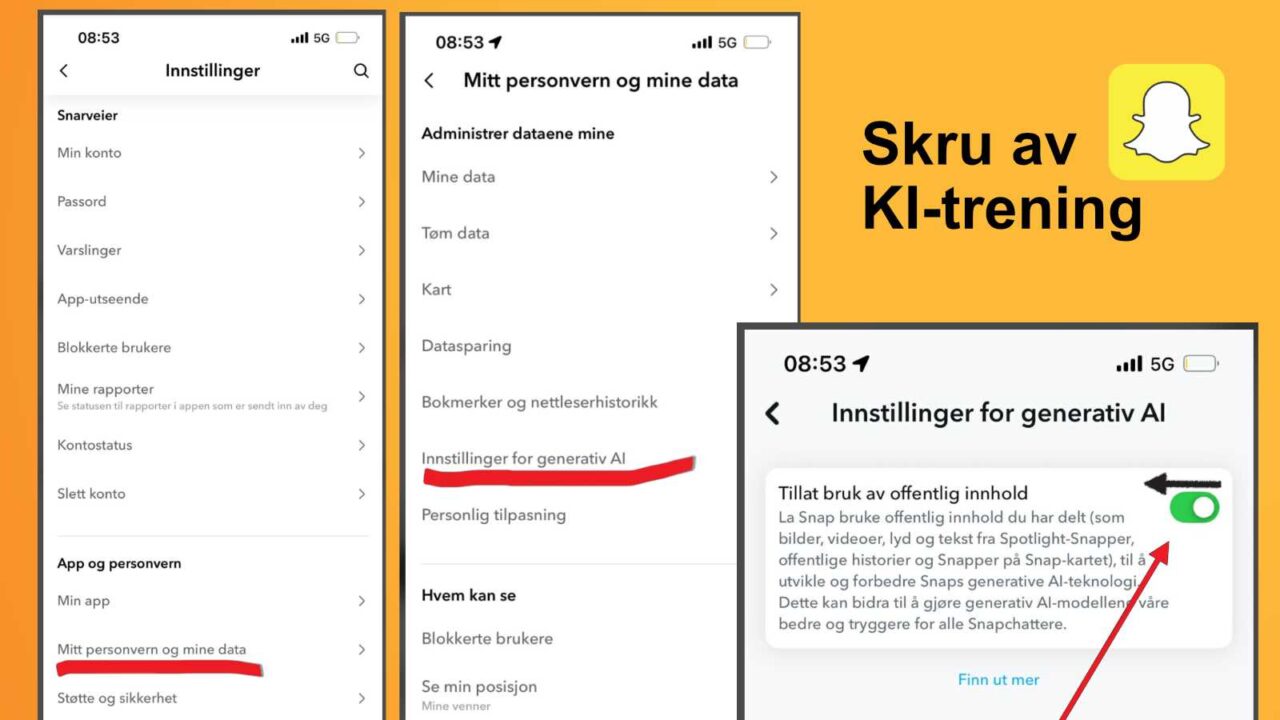

Bildet over viser hvordan du kan hindre at Snapchat lar kunstig intelligens trene på dine innlegg:

- Trykk på tannhjulet.

- Velg: Innstillinger.

- Velg: Mitt personvern og mine data.

- Velg: Innstillinger for generativ AI.

- Skru av: Tillat bruk av offentlig innhold

Snapchat skriver at når du sier nei til at selskapet kan la sin KI trene på dine innlegg, vil det være for sent for treningen som allerede er uført: «…but opting out does not affect training that has already taken place».

Kan tyte ut andre steder

Kunstig intelligens er en teknologi som er så avansert at utviklerne noen ganger selv ikke alltid forstår hvordan virker. Uansett er ideen at data inn skal bli til data ut – bearbeidet på ulike måter.

Det betyr at informasjon fra en tekst eller et bilde som en KI trener seg opp på, kan tyte ut i en annen kanal i en helt annen sammenheng. Når KI-er for eksempel lager kunstneriske bilder, og hermer etter stilen til bestemte kunstnere, kan kunstnere noen ganger kjenne igjen sine egne signaturer, selv om det ikke er de som har malt bildet.

Det er ikke klipp og lim i tradisjonell forstand, men det er matematikk. Når journalister kan lese lange avsnitt fra deres artikler gjengitt av KI-er, kan derfor kalles kopier, selv om KI-eksperter kanskje ikke er enig i ordbruken. Men det spiller egentlig ingen rolle hvordan man produserer en kopi. Man kan skrive av en tekst for hånd og hogge det inn i stein, eller man ka ta bilde av teksten og printe ut på papir, eller man kan benytte KI og avansert matematikk, det er bare ulike teknikker.

Et ekstra problem med KI-er, er at de kan finne på ting som ikke er sant. De kan knytte sammen noe som er sant med noe som er usant. En mann opplevde i 2025 at KI-en Chatgpt påsto at han hadde myrdet sine barn. Navnet hans var sant, men det var usant at han hadde myrdet noen.

KI-selskapene støvsuger internett for materiale som deres KI-er kan trene seg opp på som så KI-ene kan «huske» på sitt litt mystiske matematiske vis. I april 2025 ville Meta trene på brukernes innlegg, vi viste hvordan du kunne si nei til Metas trening på dine innlegg. Denne gangen gjelder det Snapchat.

Lover å ikke trene seg opp på elever

Også Microsoft har kunstig intelligens. Norske skoler kan bruke KI-en som kalles Microsoft Copilot. Selskapet lover at deres KI ikke skal trene seg opp på elevenes arbeid. Da kan man spørre: Hvorfor et slikt løfte? Hva er problemet eller risikoen? Svaret er det som allerede er forklart: KI-trening kan bety at informasjon kan gjengis i en helt annen kanal i en helt annen sammenheng.

Dersom du lar KI-er trene seg opp på dine innlegg i sosiale medier, mister du kontrollen på tekstene dine og hvordan informasjon fra disse kan bli brukt andre steder. Full kontroll har du aldri, for det kan tenkes at enkeltpersoner utfører manuell klipp og lim. Men dette vil uansett være i mye mindre grad enn om du lar en KI lese alt og lagre matematisk for evig tid.

Barnevaktens råd

- Ikke la KI-er trene på dine innlegg.

- Når du benytter KI-er, ikke fortell private opplysninger til den.

- Vær forsiktig med KI-er som tilbys i sosiale medier, bruk heller KI-er som er adskilt fra andre tjenester og som hevder at de har bra personvern og ikke trener seg videre opp på hva du skriver eller deler av bilder og videoer.