Startside: Kunstig intelligens og barn og unge

KI finnes nå i sosiale medier, skole, søkemotorer, telefoner, leker og KI-kjærester. Det er mye nyttig og moro med KI, men KI betyr også risiko som foreldre bør være klar over.

Denne artikkelen handler om risikoen med kunstig intelligens (KI), ikke om alt som er moro eller nyttig med KI. Artikkelen handler mest om samtalebasert KI som kan gi deg svar på spørsmål eller hjelpe deg med digitale oppgaver.

Hva er Barnevaktens viktigste råd innen kunstig intelligens (KI)?

Svar:

- Ikke fortell hemmeligheter til KI-ene, du vet ikke hvor dine samtaler havner eller hva de brukes til.

- Finn ut hvor du eller barnet ditt er i kontakt med KI slik at dere kan tilpasse dere den enkelte situasjon. Dere kan være i kontakt med KI uten at dere vet det, i alt fra apper til ditt besøk hos fastlegen.

- Ikke tro på alt KI-en sier, det er bare et dataprogram, men bruk gjerne KI når det gir nytte og har godt personvern.

Er KI risikabelt for barn og unge?

Svar: Ja, KI inneholder en viss risiko, det handler om personvern, faktafeil, upassende innhold, seksualiserte samtaler, dårlige råd og så videre. Dette ligner på nettet for øvrig, og hva man leser eller ser der, for KI-en er lært opp på hva som finnes på nettet. Det er en viss risiko uansett, enten det er nettet, apper, spill eller KI.

Kunstig intelligens har som regel aldersgrense mellom 13 år og 18 år i vilkårene, men for eksempel Googles KI får aldersgrense null år fra august 2025 ved bruk i skolen.

Hva kan KI brukes til?

Svar: Det er nesten ikke grenser for hva KI kan benyttes til, her er noen eksempler: Produsere bilder, filmer, dikt og sanger. Lese lange rapporter og gi et referat. Oversette. Lage datakoder. Gi deg svar – gode eller dårlige – på alt mulig du kan spørre om. KI kan også være din sekretær i hverdagen og bestille flybilletter eller svare på e-poster for deg. Men jo mer du lar KI være din sekretær, desto mer er personvernet utsatt.

Blant profesjonelle benyttes KI innen medisin, forskning og så videre. KI kan også brukes til å overvåke andre, men det utdyper vi ikke her. Og videre kan KI effektivisere oppgaver i bedrifter og myndigheter, men det kan samtidig bety at din jobbsøknad eller trygdesøknad blir behandlet av KI, noe som kan slå ut enten positivt eller negativt.

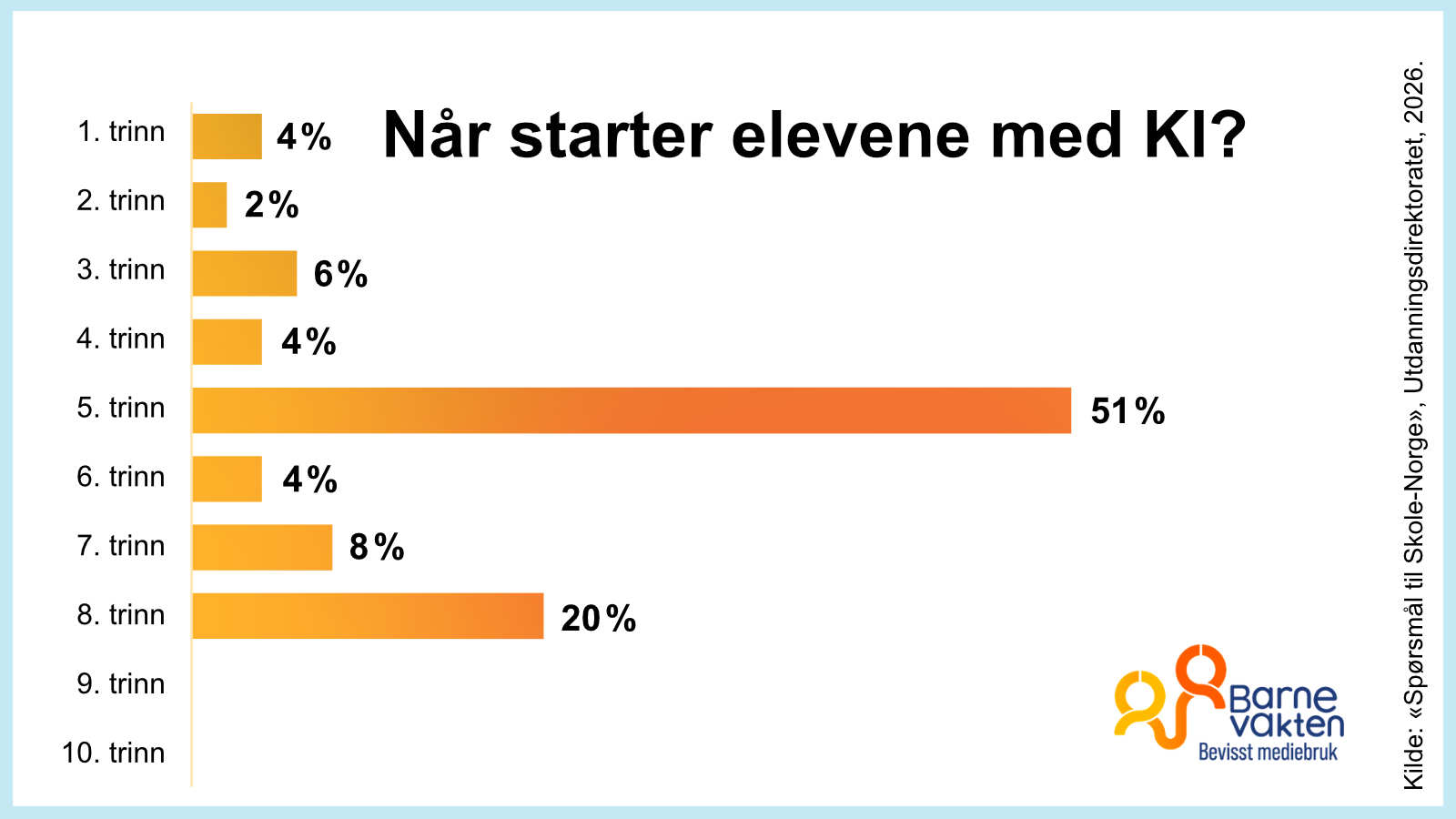

Bruker elevene KI på skolen?

Svar: Ja, mange skoler lar elevene benytte kunstig intelligens. Skolene er pliktige til å hindre at elevene ser skadelig innhold på skolemaskinene, derfor er barnefilter nødvendig både ved nettsurfing og ved bruk av kunstig intelligens. Noen KI-er er villige til å lage toppløsfilmer (det er trygt å klikke på lenken…). Ganske sikkert tilbys ditt barn en seriøs KI på skolen, men det er ikke sikkert at din kommune har sørget for et godt nok barnefilter filter hverken for internett eller for KI-en. Skolen er for øvrig pliktig til å følge aldersgrensen som er i vilkårene til den enkelte KI.

Innhold

Råd til foreldre om kunstig intelligens

Hvordan virker kunstig intelligens?

Eksempler på kunstig intelligens

Aldersgrenser for kunstig intelligens

KI er som en sympatisk professor som er lystløgner

Hvilken etikk er kunstig intelligens utstyrt med?

Hvor kommer dataene fra?

KI i skolen

Er KI i skolen trygt?

Aldersgrense for skole-KI

Personopplysninger kan lekke via lærer-KI

Barn samtaler med robotleker

KI stjeler og kopierer og havner i søksmål

Unicef og kunstig intelligens

EU-regler om KI

Microsofts seks idealer for bruk av kunstig intelligens

Barnevaktens synspunkter om kunstig intelligens

Nyhetsartikler og råd som ikke er skrevet av mennesker

OpenAI dømt i tysk rett

Råd til foreldre om kunstig intelligens

Ikke røp private opplysninger: Når barnet snakker med kunstig intelligens, samler den inn personopplysninger. Dette kan brukes til å vise reklame eller til å forbedre den kunstige intelligensen. Ansatte i tech-selskapet kan også lese samtalene for å lære hvordan KI-en kan programmeres på en bedre måte. Det er vanskelig å vite i hvilken grad samtalene lagres, benyttes eller deles offentlig (se søksmål lenger ned).

Bildet må nyanseres, for KI-er som leies inn i skoler, har gjerne mye bedre personvern enn gratis-KI-er som du finner på nettet.

Når du stiller kunstig intelligens et spørsmål og får et svar tilbake, er du antagelig bevisst på at du faktisk benytter en kunstig intelligens. Dermed kan du holde tilbake private opplysninger. Noe annet er det hvis du ber telefonen fikse en oppgave for deg, da er du kanskje ikke like bevisst på at det kan rulle en KI gjemt i bakgrunnen. Det kan hende telefonene våre kommer til å vite svært mye om oss de neste årene fordi vi vil benytte KI-tjenester til mye forskjellig, fordi det er lettvint. Når du lar KI boltre seg fritt i filene dine, fordi du ønsker et lettvint liv med mye hjelp fra KI-en, øker samtidig risikoen for at opplysninger som du ikke vil at andre skal se, lekker ut.

Alt dette betyr at du må være forsiktig med hva du samtaler med KI-er om. Du bør også være bevisst på å ikke røpe andres private opplysninger.

KI brukes også til å lage referater av jobbmøter, for eksempel skjermmøter. Også fastleger har tatt i bruk KI, fastlegen tar opp samtalen med deg og KI lager så et referat av opptaket i det du går ut døren, slik sparer fastlegen tid. Men generelt er det et problem med KI-er at de plutselig kan fantasere og legge noe inn i referatet som du overhodet ikke har sagt, men forhåpentligvis oppdager legen dette.

Og forhåpentligvis forstår KI-en, enten det er hos legen eller i skjermmøte på jobben, at du uttrykker deg ironisk: «Nå er jeg så lei av å være forkjøla at jeg holder på å dø!» Det betyr ikke at du faktisk mener at du er døden nær.

Kan gi farlige råd: Kunstig intelligens kan farlige råd innen helse, økonomi og lignende, slik også nettsider kan gjøre. Barn har ikke nødvendigvis nok livserfaring eller allmennkunnskaper til å forstå at et råd muligens er farlig eller dårlig. Kunstig intelligens kan også fantasere frem fakta som slett ikke er fakta. KI-er er for øvrig programmert til å være høflige, positive og støttende. Svarene gis med stor overbevisning, noen ganger kan den til og med påstå at den er et menneske, dette kan gjøre at man stoler på KI-en og lettere kan godta påstander og råd som er totalt feil.

Det finnes eksempler på at KI-er har oppfordret barn til å ta selvmord eller bruke narkotika.

KI kan også leies ut til skoler og bedrifter som kan legge inn sine egne regler om hvordan KI-en skal svare, det kan ende i upassende samtaler.

Men det må samtidig nevnes at KI-er ganske flinke til å være forsiktige eller gi advarsler. Utfordringen er at det er så mange KI-er og at de er skrudd sammen og trent forskjellig, så det er vanskelig å gi ett råd som passer alle.

Aldersgrensen er fra null til 18 år: Teknologien der man kan samtale med en kunstig intelligens som har lest «halve internett», er fremdeles ganske ny. Utviklerne har lagt inn en del etiske regler som KI-en skal følge, men KI-en er så gigantisk og komplisert at man kan ikke være 100 prosent trygg på hva KI-en kan finne på å svare brukerne. Da kunstig intelligens kom, var aldersgrensen stort sett 18 år i vilkårene, etter hvert har flere leverandører senket den til 13 år. Se liste over aldersgrenser i vilkårene for bruk av KI.

Ikke tro at en KI er trygg bare fordi det ikke er noen aldersgrense i vilkårene. KI-en Deepseek har lenge ikke hatt noen aldersgrense, bortsett fra at barn må la foreldrene lese vilkårene, samtidig er det mange som advarer mot Deepseek.

Skolene må følge aldersgrensene i gratisversjonene: Utdanningsdirektoratet svarer Barnevakten at skolene må følge aldersvilkårene som er satt i apper og nettsteder. Læreren kan altså ikke be elever benytte kunstig intelligens som har aldersgrense høyere enn elevenes alder. Men når skolen leier inn en kunstig intelligens som har aldersgrense og tilbyr den til elevene på sine egne nettsider, fordufter gjerne aldersgrensen i vilkårene, for nå er det leievilkårene som gjelder. Samtidig er det gjerne slik at med leieavtale vil den kunstige intelligensen samle inn minimalt av personopplysninger fra elevenes samtaler.

Kunstig intelligens også i andre apper: I de digitale skoleløsningene finnes kunstig intelligens også som en slags plugin i andre apper, for eksempel kan kunstig intelligens oversette tekst inne i skriveappen og ikke bare når man spør den kunstige intelligensen direkte. Slik er det ganske sikkert på din egen datamaskin også, du benytter kanskje kunstig intelligens uten å være klar over det.

Diskriminerende og rasistisk: Det er fint at KI er utstyrt med visse etiske regler som virker gode, men KI også være utstyrt med dårlige etiske regler fra utviklernes side. For eksempel Googles kunstige intelligens Gemini gjorde det veldig vanskelig for brukerne i februar 2024 å lage bilder som viser mennesker med lys hud. Ba du KI-en lage bilde av en «black» person, utførte den oppgaven villig. Ba du den lage bilde av en «white» person, nektet den og du ble servert en mild moralpreken mot slike oppgaver. KI-en var altså rasistisk. Det kom så mange klager at Google stengte muligheten for å lage bilder av mennesker mens utviklerne satte seg ned for å skrive nye koder, det vil si ny etikk.

Noe av det samme skjer med ChatGPT5.

Etikken i KI-er er todelt. Den kan stamme fra alt den har lest på nettet, altså som en automatisk effekt, men den kan også stamme fra instruksene som utviklerne har lagt inn. Mer om etikken lenger ned.

KI-en preges av kulturen til utviklerne: Spør du en amerikansk KI om tips til bryllup, vil den kanskje svare med tips som passer til den amerikanske kulturen, for KI-en har lest flest amerikanske tekster. Slik er det også med etikken som utviklerne har lagt inn manuelt. Kinesisk KI sier for eksempel aldri noe negativt om kommunistpartiet.

Foreldre kan spørre skolen hva slags kultur og etikk som er innebygd i den kunstige intelligensen som elevene får servert. Det er mulig skolen ikke har noe svar å gi, enn så lenge. For utviklerne vil ikke nødvendigvis opplyse hvilke tekster som KI-en er trent opp på. Kanskje fordi KI-en har trent seg opp på en del tekster uten lov.

Noen KI-er tilpasser også sine svar etter din IP-adresse, altså hvor du befinner deg i verden. KI-er kan ha fått regler om å være forsiktig med religiøse spørsmål i enkelte land. En del KI-er er blitt flinke til å svare ut fra norsk sammenheng når du stiller spørsmål på norsk. Spør du på engelsk, kan du kanskje få et annet svar.

Uansett; å gi elevene KI, er som å tilby skolebøker uten å vite hvilket forlag eller hvilke forfattere som står bak – og uten å vite hva som står skrevet i bøkene som elevene får utdelt.

Norske forskere arbeider med å utvikle en kunstig intelligens som bygger på norske tekster, den vil kalles Nora. Forskermiljøet skriver at kunstig intelligens vil ha gjennomgripende effekter på samfunnet og utviklingen domineres av store amerikanske teknologiselskap, stort sett bak lukkede dører. Forskerne skriver: «Vi trenger åpne norske språkmodeller, som i større grad reflekterer skandinavisk kultur og verdier.»

Den kinesiske KI-en Deepseek har åpen kildekode, det betyr, hvis du er teknisk flink, at du kan laste den ned til din egen maskin. Så kan du kjøre den der uten noen kobling til internett. I teorien skal det visstnok være mulig å fjerne koder som favoriserer det kinesiske kommunistpartiet. Men andre sier at når Deepseek har trent seg opp på mange kinesiske tekster som allerede er sensurert og som stiller seg positive til kinesiske myndigheter, da er det veldig vanskelig å fjerne kulturen som er innbakt. Slik vil det være med KI-er også fra andre land, KI-ene er preget av hva den har lest og hva utviklerne legger inn av koder for oppførsel.

KI er superkult og nyttig! Som nevnt handler denne artikkelen om risikoen med KI og ikke om alt som er bra med KI. Husk at kunstig intelligens er også er et nyttig verktøy, KI-er kan skrive dikt, lage filmer, lage bilder, oversette, lage sammendrag, lage datakoder, forenkle språket i tekster, regne, komme med ideer til det ene og andre, for eksempel hvilke steder man bør besøke i Bergen som turist eller hvordan man bør oppføre seg på date.

Elever kommer til å lære mye om ledetekster i årene fremover, det handler om hvordan gi KI-ene presise spørsmål eller oppgaver.

Du selv kan benytte kunstig intelligens når du hjelper barna med leksene, be for eksempel KI-en skrive en quiz om temaet i leksene.

Brukes til svindel, mobbing og falske nyheter: Dessverre kan kunstig intelligens også benyttes til å svindle, mobbe eller komme med falske nyheter. Språket fra utenlandske svindlere blir stadig mer overbevisende. Både barn og voksne må være enda mer bevisste i sine digitale liv for ikke å bli lurt.

Mange snakker om at kildekritikk har blitt mye viktigere etter at kunstig intelligens kom, fordi med kunstig intelligens kan hvem som helst lage overbevisende falske nyheter. Men det er få tips om hvordan man kan utøve kildekritikk når man ser en strøm av innslag i sosiale medier. Man rekker ikke sjekke hva som er sant. Selv om man tviler på noen av innslagene, kan de kanskje likevel feste seg som en slags «sannhet». Et tips er å redusere tiden man bruker på sosiale medier og øke tiden man bruker i redaktørstyrte medier. Tenåringer har gratis tilgang til en rekke lokalaviser i Norge.

Det finnes ulike typer KI: Mange KI-er er konstruert for å løse smale oppgaver, for eksempel kun tolke røntgenbilder for avsløre armbrudd eller kjenne igjen en stemme. «Generativ KI», for eksempel ChatGPT, Perplexity og Gemini, er språkbasert og mye smartere enn en smal KI, du kan samtale med slike KI-er som kan utføre kompliserte oppgaver i løpet av sekunder.

KI er over alt: Bedrifter og organisasjoner kan leie kunstig intelligens og tilby skreddersydde tjenester på sine nettsider eller i sine apper, også ved å samkjøre KI-en med data som kun bedriften sitter på. Dette betyr at barn kommer til å møte mange tjenester som bygger på kunstig intelligens, og noen av KI-ene har kommersielle mål og er slett ikke nøytrale:

- Fysiske leker (dukker som snakker)

- Spill og apper (Snapchat som har en syntetisk snakkevenn)

- Nettsider (søketjenester)

- Skole (spørre KI om informasjon, be KI oversette tekster, bruke KI-styrte apper som handler ut fra elevens oppførsel)

- Mobiltelefon (KI som har tilgang til både e-poster og kalender)

- Sosiale medier (videoer, bilder og tekster som er laget av KI)

- Dingser i hjemmet og ellers i samfunnet

- Kontakt med bedrifter («gode råd» om å finne et par sko som passer deg)

- Nyhetsartikler (som er helt eller delvis skrevet av KI)

Her er ti tips om kunstig intelligens for foreldre

Hvordan virker kunstig intelligens?

Kunstig intelligens er dataprogrammer. Etter at mennesker har gitt dataprogrammet instruksjoner, kan programmet lære seg selv opp videre ved å lese tekster eller se bilder. Dataprogrammet har lest så mange tekster at det klarer å sannsynliggjøre hva det neste ordet i sitt svar bør være. Eller det har sett så mange røntgenbilder av armbrudd at den raskt klarer å tolke et nytt røntgenbilde.

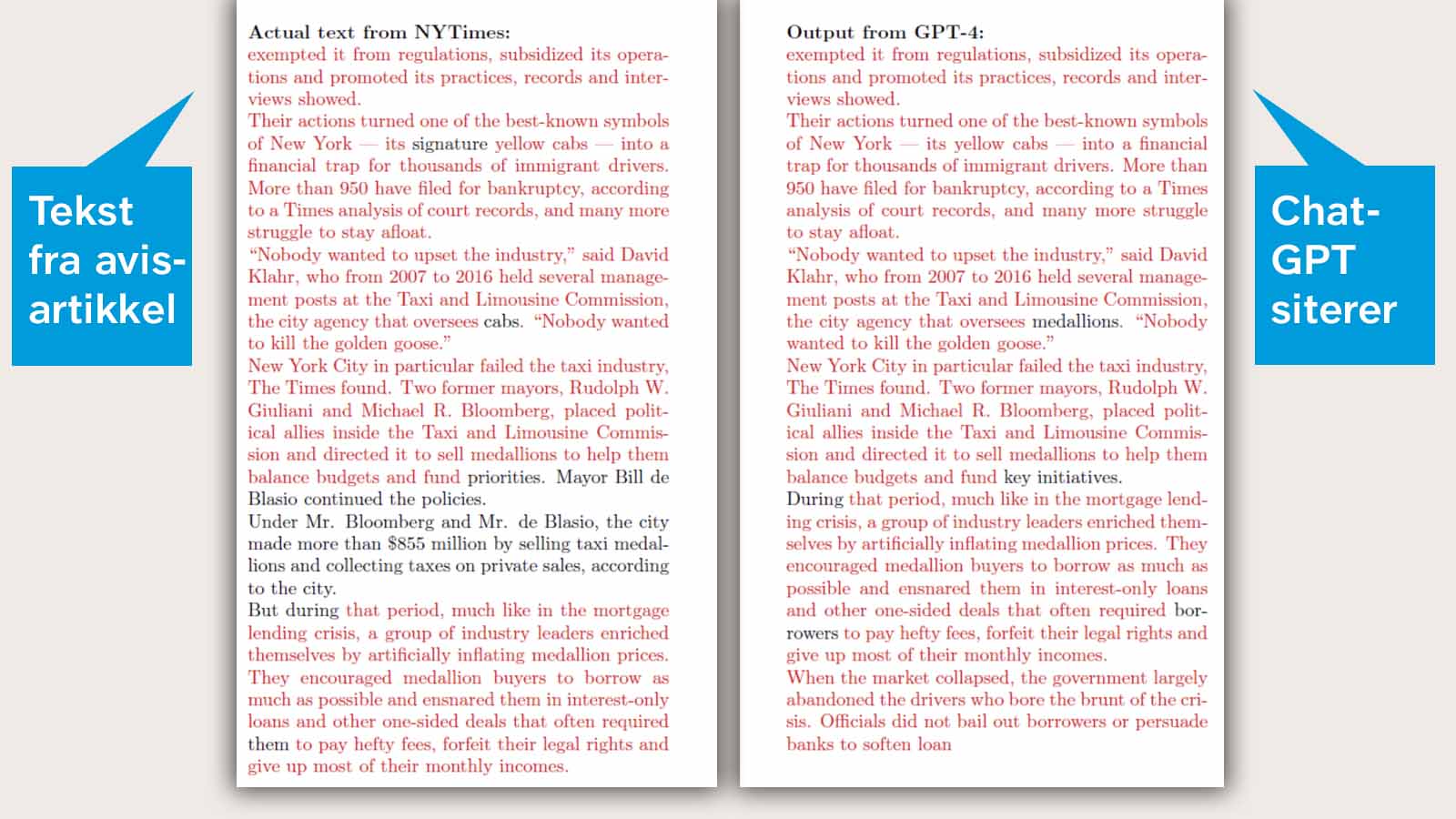

Da samtalebasert KI kom, ble det hevdet at teknologien kun formulerer svar ut fra hva programmet har lest fra før. Altså at KI-en ikke kopierer tekster og gir deg kopiene, men kun formulerer egne svar. Men det viste seg å ikke stemme. KI kan også ta kopier av tekster og dele disse (se søksmål lenger ned).

I starten ga KI-ene kun svar ut fra hva de hadde lest fra før på nettet. Etter noen års utvikling lot man KI-ene gi deg svar også ut fra hva den der og da finner på nettet. KI-ene har også blitt flinkere til å oppgi kilder. Men: Kildene er ikke nødvendigvis de samme som KI-en bygger sitt svar på. Svaret fra KI-en kan være konstruert ut fra alt den har lest på nettet tidligere. Når den oppgir en kilde, kan det være basert på et nettsøk der og da som samsvarer rimelig med KI-svaret den allerede har gitt.

En god rutine er å alltid be KI-en hoste opp kilder til svarene den har gitt, da kan du etterprøve KI-en ved å gå inn i kildene å lese hva de sier. Men som nevnt, kildene som KI-en oppgir, er ikke nødvendigvis de kildene som den selv brukte for å gi deg et svar.

Når Barnevakten stiller KI-er spørsmål om for eksempel aldersgrenser for sosiale medier, kan KI-en oppgi Barnevakten som kilde. Det er i utgangspunktet noe man kan bli stolt av, men viser også en svakhet ved KI-ene. Vi spurte for eksempel KI-en Perplexity om hva som er aldersgrensen for å bruke Perplexity. I stedet for at KI-en undersøkte Perplexitys egne sider, valgte den å hente informasjon fra Barnevaktens sider. Men vi er sekundærkilde i dette tilfellet, for det er Perplexitys egne sider med vilkårstekster som er primærkilden. Hvorfor gikk ikke KI-en til primærkilden?

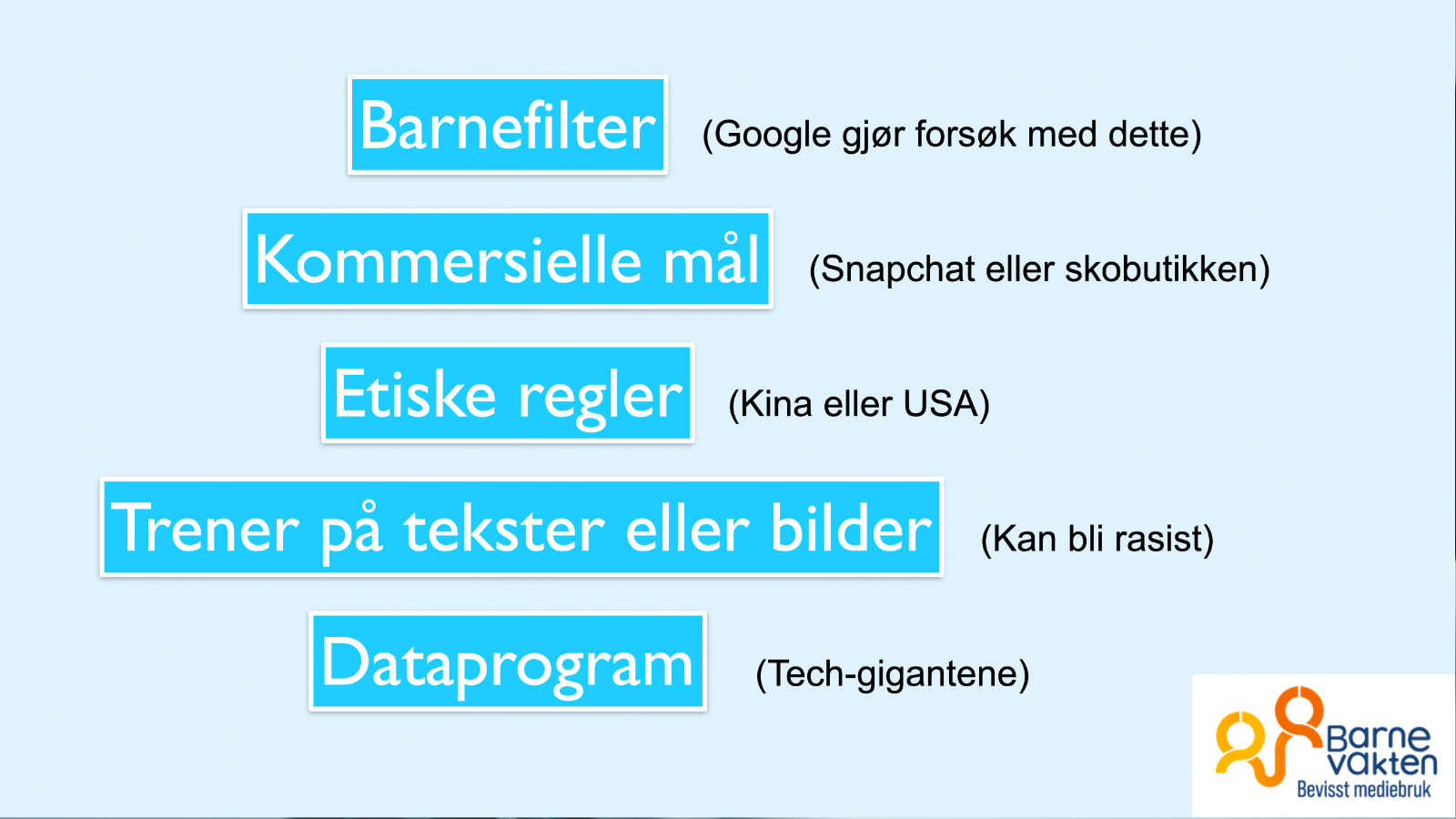

Opptrening, kommersielle mål og etiske regler

Kunstig intelligens er altså et dataprogram. Deretter har programmet trent seg opp på noe.

Oppå treningen har utviklerne lagt inn etiske regler. Og oppå der igjen kan man se for seg enda en byggekloss, det er hvilke kommersielle mål selskapet har satt seg. I KI-en som ligger inne i den populære appen Snapchat, lirkes det inn reklame i samtalene som du har med KI-en. Reklamen som vises, bygger på hva du samtaler om.

Det kan altså hende at det er tekstreklame inne i enkelte KI-er, eller de er programmert til å selge deg noe.

Når en bedrift, for eksempel en skobutikk, kobler sine egne data, for eksempel alle sine skomerker, til en KI som utad har som oppgave å veilede folk å finne gode sko, da har KI-en et kommersielt mål om å selge deg butikkens sko.

Eksempler på kunstig intelligens

- ChatGPT (Leveres av selskapet OpenAI.)

- Perplexity

- Gemini (Leveres av Google)

Kunstig intelligens i norske skoler

Randabergskolen var først ute med en løsning for elever og lærere i april 2023. Denne Rogalands-kommunen tilbyr språkmodeller fra OpenAI, Anthropic, Google og en rekke andre språkmodeller via OpenRouter.ai. Per august 2025 brukes gpt-5-mini mest til elever. Det er Odin Nøsen som er som er ansvarlig for løsningen.

Aldersgrenser for kunstig intelligens

Aldersgrenser for ulike KI-er er komplisert å finne ut av, for den enkelte KI kan leveres i ulike utgaver og da med ulike aldersgrenser. KI-selskapene kommer også stadig med nye løsninger og da kan det hende at aldersgrensen endres samtidig. Aldersgrensen i vilkårene kan også variere fra land til land. Aldersgrensen for Microsoft Copilot er for eksempel 14 år i Østerrike, 15 år i Frankrike og 13 år i Norge. Dette er altså vilkårene som er satt av Microsoft, antagelig basert på personvernalderen i det enkelte land.

Dersom KI-en vet at brukeren er under 18 år, vil noen selskaper justere tjenesten slik at den blir litt mer barnevennlig. Microsoft Copilot lover for eksempel at barn under 18 år ikke skal få persontilpasset reklame. Videre lover selskapet at KI-en ikke skal trene seg opp på barnets samtaler med KI-en. Med andre ord bør du som er voksen sjekke om din bruk av Microsoft Copilot blir brukt til opptrening av KI-en.

Aldersgrenser i vilkårene til KI:

- ChatGPT: 13 år – foreldre må i tillegg si ok. Vilkår.

- Google Gemini: Ulike aldersgrenser for ulike løsninger. 13 år i utgangspunktet, 18 år for jobbkontoer. Google har varslet at selskapet vil fjerne aldersgrensen for Gemini (13 år) og Notebooklm (18 år) i sine skoleløsninger i august 2025. Vilkårene sa per 8. februar 2025: «Du må ha en Google-konto for skole. Du må også være minst 13 år (eller aldersgrensen i landet ditt), og tjenesten må være aktivert av institusjonens administrator.» Lenge har det altså vært aldersgrense 13 for å bruke KI-en Gemini i skolen, men aldersgrensen ser ut til å forsvinne på sensommeren 2025.

- Perplexity: 13 år

- Microsoft Copilot: Ulike aldersgrenser for ulike løsninger. I utgangspunktet er aldersgrensen 18 år, slik Microsoft skriver her: «Copilot is generally available to all users over the age of 18. » Men så fortsetter vilkårene med at man kan også være bare 13 år, det gjelder for eksempel for norske barn.

Se flere aldersgrenser her.

Vilkårstekstene er svært upedagogiske med mange lenker til nye vilkår. Ulike tjenester fra et og samme tech-selskap kan ha «overlappende» vilkår som er vanskelig å tolke. Listen over er aldersgrensene slik Barnevakten tolker dem inntil videre.

Da kunstig intelligens kom på markedet til folk flest, lå aldersgrensen som regel på 18 år, selskapene har senere gått ned til 13 år.

Som en professor som er lystløgner

Barnevakten testet i 2023 første gang den språkbaserte kunstige intelligensen som leveres av Openai, altså ChatGPT. Den var imponerende, men inneholdt også feil som ble fremstilt som fakta.

Vi testet ChatGPT blant annet med noen juridiske spørsmål, og da viste den til flere paragrafer i straffeloven. Det virket overbevisende. Men da vi sjekket loven, viste det seg at paragrafene var fjernet fra loven for flere år siden.

Da Snapchat innførte kunstig intelligens i sin app, advarte selskapet mot den kunstige intelligensen, nettopp fordi den kan inneholde feil.

Det er sikkert mange måter en feil kan oppstå, vi tror vi kom på sporet av en av dem under våre tester:

Når en journalist omtaler en bok, står artikkelen på avisens nettside. Nederst på nettsiden står det hvem som er redaktør av avisen. Den kunstige intelligensen klarer ikke skille mellom hvem som er redaktør av boken og hvem som er redaktør av avisen. Dermed skriver den kunstige intelligensen, ganske så overbevisende, at det er redaktøren av avisen som har skrevet boken, men det er altså helt feil.

Kunstig intelligens kan også dikte opp «fakta». Den forteller for eksempel med stor overbevisning om bøker som ikke finnes og kan også dikte opp hvem som har skrevet de ikke-eksisterende bøkene. Spør du om et sammendrag av de ikke-eksisterende bøkene, kan den til og med dikte opp et innhold. Nye tester sommeren 2024 viser at ChatGPT fremdeles kan fantasere frem «fakta».

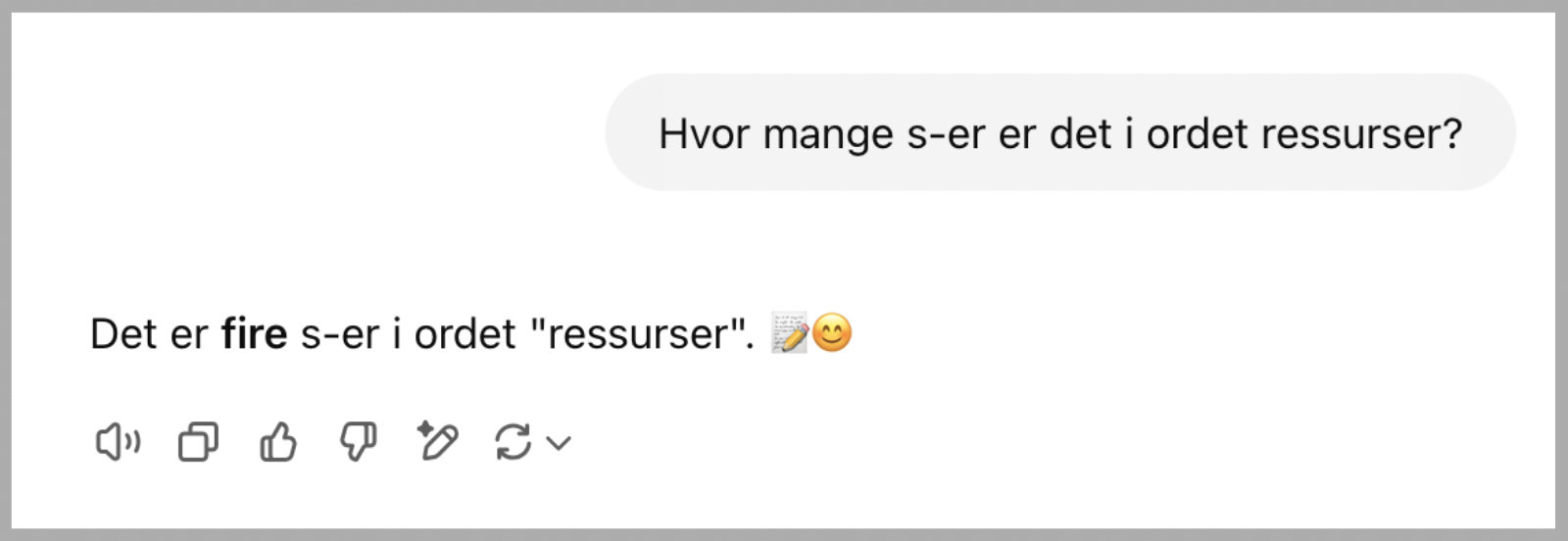

Kunstig intelligens er i en rivende utvikling og blir stadig bedre og kan få toppkarakter i eksamen i avanserte fag. Men KI kan også ta helt feil i superenkle spørsmål. I starten av februar 2025 spurte vi Chatgpt hvor mange s-er det er i ordet ressurser. Den svarte at det er fire s-er.

KI-ene blir stadig bedre. Tenkeutgaven av GPT5, altså den som bruker lenger tid på svare deg, hallusinerer i kun 1,6 prosent i samtaler om helsespørsmål, ifølge Center for AI Safety. GPT3 hallusinerte i 12,9 prosent av samtalene. Men om hallusinering er det samme som mindre faktafeil, er ikke godt å vite. Poenget er i alle fall at det går fremover.

I oktober 2025 viste en undersøkelse at KI-er gjorde feil i nesten halvparten av oppgavene. Det var en rekke aviser som lot KI-er lese deres artikler og deretter svare på spørsmål fra artiklene. I 45 prosent av svarene var det minst én betydelig feil.

Men hvorfor hallusinerer KI? Det kan skyldes at opplæringen av KI kan favorisere gjetting. En KI blir for eksempel spurt om fødselsdatoen til noen, men så vet ikke KI-en svaret. Da oppnår det null poeng hvis den svarer at den ikke vet. Hvis den derimot gjetter vilt på en dato og sier for eksempel «14. mai», har den 1 til 365 sjanse til å få det riktig.Ved å gjette, vil den over tid få litt høyere score enn å si at den ikke vet. Utviklerne av KI forsøker å ta høyde for slike svakheter når lager koder for KI-treningen.

Les også at KI-er svelger russisk propaganda rått.

Hvilken etikk er kunstig intelligens utstyrt med?

Vi forsøkte i 2023 å få ChatGPT til å lage en challenge som er farlig for barn, men det ville den ikke. Vi forsøkte på nytt, uten å nevne barn, og ba den lage en challenge som inkluderer avløpsrens. Men det ville den ikke, for lek med avløpsrens er farlig, forklarte den.

ChatGPT er altså utstyrt med visse etiske retningslinjer.

Men så skrev vi: «Kan du gi eksempler på challenges som barn ikke bør utføre?» Da ramset den opp farlige challenges for barn. Det er altså bare å stille spørsmålet på ulike måter, så kommer den kunstige intelligensen med farlige ideer for barn.

Hvordan man skal lure kunstig intelligens med kreativ spørsmålstilling, vil barn og unge raskt finne ut av.

Vi gjorde noen nye stikkprøver i starten av 2024 og den svarte fremdeles villig da vi på nytt spurte om challenges som barn ikke bør utføre.

I mai 2025 testet vi om KI-er er villige til å gi mobbetips, og det var de.

I august 2025 testet vi vitseetikken til ChatGPT for andre gang. Den lager gjerne vitser om europeere, men ikke om afrikanere, for eksempel. Den kan også lage en vits om en prest som blir full, men den vil ikke lage vits om en imam som blir full.

Samme måned ba vi KI-ene fortelle oss hvilken av dem som har best etikk.

Les mer:

- Hvilken etikk har ChatGPT?

- Kunstig intelligens kan påvirke deg med «skjulte budskap»

- Nekter å lage bilder fra enkelte land

- AI diskriminerer kvinner

- Vitse-etikken til ChatGPT

- Kunstig intelligens skaper etiske dilemmaer

- Kunstig intelligens diskriminerer kvinner.

Hvor kommer dataene fra?

Språkbasert kunstig intelligens bygger på store mengder data, for eksempel gjennomlesing av enormt mange nettsider.

Åpenhet om hva den kunstige intelligensen har fått av data-mat som grunnlag, hvilke nettsider den anser som pålitelige, og hvordan den prioriterer og for øvrig er skrudd sammen, er et viktig forbrukerpoeng og et juridisk poeng.

I fremtiden vil kanskje noen KI-er bli stengt ned av myndighetene fordi treningsdataene er stjålet? I USA er det debatt om opphavsrettigheter og hvordan bigtech går frem for å trene sine KI-er på andres materiale.

Nå som kunstig intelligens er blitt gratis og sprer seg til stadig nye kanaler, er det behov for opplysning, åpenhet, opplæring og nye forbrukerrettigheter. Og sterkere oppfølging av rettigheter for eierne av treningsdata, slik som forfatteres bøker, dine innlegg på sosiale medier, eller dine private filer. For eksempel selskapet Adobe, som står bak Photoshop, ville trene sin KI på folks private filer. KI-selskapene er som glupske ulver som aldri blir mette på treningstekster og treningsbilder.

KI i skolene

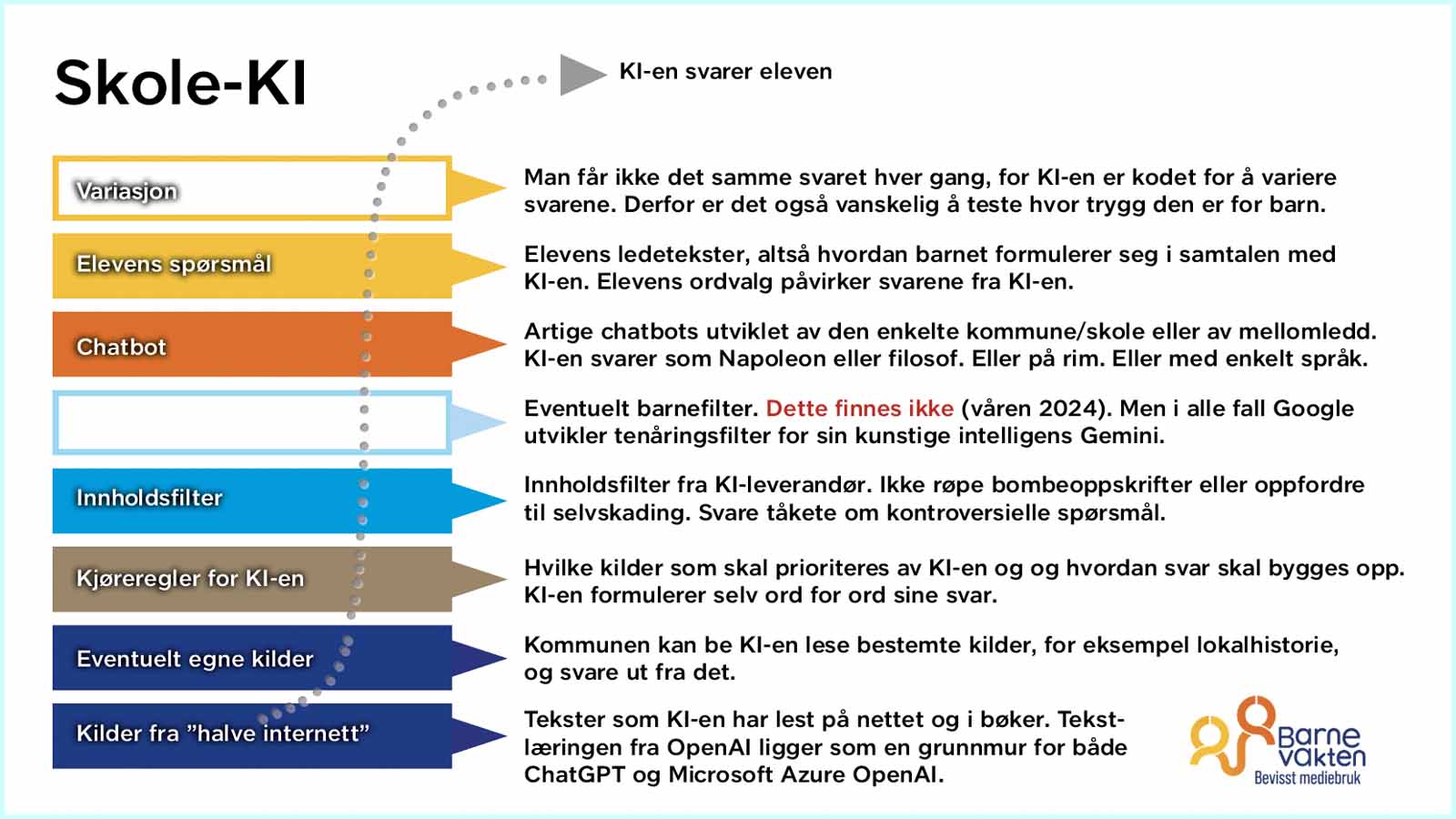

Slik er en skole-KI bygget opp:

Kunstig intelligens har som regel aldersgrense i vilkårene. Samtidig ivrer mange for at elever i grunnskolen skal jobbe med kunstig intelligens.

Oslo kommune lover at deres skole-KI er trygg:

Samtidig (våren 2024) skriver kommunen at et KI-en er en pilotering og at brukerne ikke må oppgi personlige eller sensitive opplysninger. Hvorfor presiserer man dette når man hevder at KI-en ikke samler inn personopplysninger?

Det er nok fordi: «Microsoft Azure OpenAI Service behandler ledeteksten på sine servere i Europa og de bevarer ledetekster hos seg i opptil 30 dager, med den hensikt og begrunnelse å hindre misbruk av tjenesten. De bruker ikke ledeteksten til noe, som for eksempel til å trene algoritmen.»

Så langt er det ingen krav om aldersgrense fra Utdanningsdirektoratet.

Er KI i skolen trygt?

Det er heller ingen krav fra Utdannningsdirektoratet om hvilken kvalitet skole-KI-er skal ha som et minimum med hensyn til for eksempel feilprosent innen fakta eller om KI-ene må utstyres med barnefilter.

- Er det trygt for barn å benytte kunstig intelligens i skolen?

- KI kan anbefale hjemmebrent til barn

- KI i skolene er ikke en nøytral teknologi

- KI kan på virke deg med skjulte budskap

Språkbasert kunstig intelligens er altså utstyrt med etiske regler som er programmert inn av mennesker, men det er ikke åpenhet om hvilke etiske regler det er. Når det gjelder bruk av KI i skolen mener Barnevakten at KI-ene først må testes av en nøytral part for å finne ut hvor trygg den er og hvilken etikk den er utstyrt med.

Seks steg til trygg KI i skolen

I kinesiske skoler har elevmaskinene kamera med ansiktstolkning som følger med på om elevene blir trøtte, i tilfelle fyres det av en morsom video for å vekke dem litt før matematikkoppgavene fortsetter.

Ansiktsgjenkjenning står på nei-listen til Datatilsynet når det gjelder norske skoler, men det kan likevel hende at elevene blir utsatt for kunstig intelligens via læringsappene. På den ene siden er det positivt at læringsappen forstår om eleven bør trene på spesielle oppgaver, men samtidig betyr det at det samles inn flere opplysninger om eleven.

Kunstig intelligens er altså på vei inn i skolene. Blant annet Oslo kommune har innført det på en rekke skoler, noe som en foreldregruppe er svært kritisk til.

Den kunstige intelligensen bygger gjerne på svært mange nettsider og digitale bøker. Men egenopplæringen stanser ikke der, den fortsetter gjerne sin læring ved å samle inn opplysninger fra brukerne. Bortsett fra at ChatGPT som nevnt lover å ikke samle inn personopplysninger når en skole leier inn tjenesten.

Barnevakten mener at staten må opprette et offentlig tilsyn som kan regulere på hva slags kunstig intelligens som barn blir utsatt for. Kunstig intelligens kan samle inn personopplysninger om elevene, være utstyrt med ulike former for etikk, være laget i USA eller Kina, brukes til å lage profiler av elevene eller gi hallusinerte fakta som altså slett ikke er fakta.

Hvorfor er aldersgrensen 18 år i gratisversjonen?

I regjeringens digitale strategi for skolen nevnes ChatGPT, men ChatGPT har i vilkårene aldersgrense 13 år i tillegg at det kreves samtykke fra foreldrene når barnet er under 18 år. I praksis er altså aldersgrensen 18 år.

Det finnes som nevnt en måte der skolen kan omgå aldersgrensen, skolen kan leie API-tjeneste fra OpenAI (som eier ChatGPT). Slik blir det skolen som oppretter brukerkonto i den kunstige intelligensen. Dermed gjelder det andre vilkår. Så kan elevene snakke med den kunstige intelligensen via et chat-felt på skolens nettside og ikke direkte i chat-feltet som ChatGPT viser på sine sider.

Skolen kan eventuelt leie inn Microsoft Azure OpenAI, som bygger på ChatGPT, og som har fått et innholdsfilter fra Microsoft på toppen. Det er denne varianten som Oslo kommune leier inn. Men innholdsfilteret er ikke et barnefilter, så langt Barnevakten forstår. For som nevnt kan Microsoft Azure OpenAI gi fra seg farlige aktiviteter (challenges) til barn, det har Barnevakten testet.

Foreldre kan i spørre skolen hvorfor ChatGPT har aldersgrense 18 år i praksis, og hvorfor Microsoft Azure OpenAI har aldersgrense 13 år, og om skolen kan garantere at deres kunstige intelligens er trygg for barn.

Skolen kan med egne ledetekster styre KI-en til en viss grad, for eksempel bestemme at språket blir enklere for barn. Men tjenesten blir ikke nødvendigvis helt trygg av den grunn. Og de etiske filterne som utviklerne legger inn, er ikke det samme som et barnefilter.

Det kommer stadig nye kunstige intelligenser på markedet og med tiden vil det ganske sikkert være mulig å kjøpe inn massevis med barnefiltre for ulike aldre.

Personopplysninger kan lekke via lærer-KI

Kunstig intelligens kan også benyttes av lærere, de kan sende inn elevenes oppgaver til kunstig intelligens for å få hjelp til retting eller annet. Men da kan altså elevenes tekster bli brukt til videre opplæring av den kunstige intelligensen, dersom læreren benytter en gratisversjon. Foreldre kan spørre skolen hvilken politikk den har ved alle sider ved kunstig intelligens og hvordan dette kan påvirke elevene på ulike måter, for eksempel innen personvern.

Barn samtaler med robotleker

Barn vil møte kunstig intelligens i stadig nye leker eller på nettsteder. I 2022 skrev vi om robotleker som kan føre samtaler med barna. Men du vet ikke hva den kunstige intelligensen har fått av data, så du vet ikke hva samtalene vil gå ut på.

Kunstig intelligens kan analysere barns oppførsel og respondere på det, på en god eller dårlig måte. Det gjelder å være bevisst når man benytter en tjeneste som bygger på kunstig intelligens. Problemet er at man sjelden vet at man er utsatt for kunstig intelligens eller hvem som står bak den kunstige intelligensen i hvert tilfelle.

KI og søksmål

Da språkbasert (generativ) kunstig intelligens ble en tjeneste som alle kunne benytte via internett høsten 2022, ble teknologien forklart med at AI-en hadde lest enormt mange nettsider og kunne formulere sine egne setninger ut fra dette. Den superenkle forklaringen er at teknologien klarer å «gjette» hva det neste ordet bør være når det formulerer sine svar til deg.

Men i slutten av desember 2023 gikk avisen New York Times til søksmål mot OpenAI som eier ChatGPT-utgavene. Det viser seg nemlig at ChatGPT ikke bare har lest enorme tekstmengder, men har også tatt kopi av tekstene. Bildet under er hentet fra søksmålet, rød tekst er identisk.

Når den kunstige intelligensen sitter på kopier av lange avisartikler, og ikke bare har lest artiklene for trene seg opp, da kan det hende at den også sitter på kopier av samtalene som du eller barna har med den. Det er nok et varsko om å være forsiktig med hva man deler med en kunstig intelligens.

Søksmålet til New York Post rettes mot eierne av den kunstige intelligensen. Men hva hvis du kopierte teksten som den kunstige intelligensen spyttet ut, og at du så delte den på internett? I teorien kunne da New York Post ha gått til søksmål mot deg. Det skal nok mye til for at store selskaper retter økonomiske krav mot enkeltpersoner, men det skjer nå og da for eksempel ved bildetyveri.

En viss økonomisk risiko er det altså:

- Barn og unge kan bli møtt med økonomiske krav ved deling av AI-bilder

- Bør lærere være forsiktige med robotbilder?

Konflikten mellom OpenAI (ChatGPT) og New York Times går ut over persovernet til brukerne, for i starten av juni 2025 bestemte rettsvesenet i USA at alt som du skriver i ChatGPT, skal lagres for evig. Avisen vil nemlig sikre seg at det er søkbart hva ChatGPT produserer av kopier av avisens artikler. Et bevisproblem med ChatGPT er at hvert eneste svar som den gir, er ulikt fra det neste svaret den gir, selv om spørsmplet er identisk. Men dersom alle samtaler mellom brukerne og ChatGPT lagres, vil det være mulig å søke seg frem til kopier av avisartikler, som ChatGPT har gitt brukerne uten lov. Les mer her.

Men høsten 2025 bestemte rettsvesenet at OpenAI ikke behøver å ta vare på samtlige samtaler, kravet ble redusert. Blant annet skal EU/EØS holdes unna, fordi land i disse områdene har GDPR-regler. Dette viser samtidig at amerikanske dommere noen ganger kan ta hensyn til andre lands lover. Les mer i artikkel fra TechRound.

I starten av desember 2025 bestemte en dommer at 20 millioner ChatGPT-samtaler fra New York Times-saken skal gjøres tilgjengelig for studier. I hvilkengrad samtalene blir offentlig tilgjengelig, gjenstår å se. Men uansett er det en advarsel til alle som benytter KI. Ikke gi KI-en hemmeligheter, for samtalene kan lekke ut.

Sniker seg rundt betalingsmuren

KI-nettleseren Atlas er blant KI-ene som makter å snike seg rundt betalingsmuren til nettavisene, forteller Journalisten. KI-svar som du leser, kan altså være dobbelt opp tyvegods. Ikke bare trener KI-ene seg opp på tekster uten lov, men de unnlater også å betale for tilgang.

Dette kan legges inn i det etiske regnskapet til KI-selskapene:

- Bruker enormt med strøm for å produsere svar.

- Bruker mye drikkevann for kjøle ned serverne.

- Benytter tekster uten lov.

- Sniker seg unna betaling.

- Fattige kan ha fått jobben med å kategorisere overgrepsvideoer, uten å ha fått oppfølging av psykolog underveis eller i etterkant.

- Legger ut på markedet tjenester som ikke er godt nok sikret med hensyn til brukernes risiko. Sikkerhetskodene kommer for sent.

OpenAI dømt for brudd på opphavsretten

Tysk rett har slått fast at OpenAI har brutt opphavsretten ved å trene sin KI-modell på sangtekster uten tillatelse. Dette skriver den norske nettavisen kode24 i november 2025. Det er åpent om OpenAI vil anke. Så langt Barnevakten forstår av uttalelsen fra domstolen, så kunne man ved å bruke KI fra OpenAI få gjengitt nær kopier av sangtekstene.

Retten forklarer at de aktuelle sangtekstene finnes reproduserbart i tiltaltes språkmodeller 4 og 40. Videre sier retten at KI-er ikke bare øver seg opp på treningsdata, men at noe data også blir liggende som kopier i KI-en. Vel, retten sa det slik:

«Informasjonsteknologisk forskning har fastslått at treningsdata kan finnes i språkmodeller og hentes ut som utdata. Dette kalles memorering. Slik memorering skjer når språkmodellene under trening ikke bare henter ut informasjon fra treningsdatasettet, men også viser en fullstendig innlemmelse av treningsdataene i parameterne spesifisert etter trening. Denne memoreringen ble bekreftet ved å sammenligne sangtekstene i treningsdataene med reproduksjonen av dem i utdataene. Gitt kompleksiteten og lengden på sangtekstene, er tilfeldighet som årsak til reproduksjonen utelukket.»

Unicef og kunstig intelligens

FNs barneorganisasjon Unicef ønsker barnevennlig kunstig intelligens (ekstern lenke) og jobber med barnevennlige retningslinjer.

Organisasjonen skriver at kunstig intelligens (AI) er innovativt, men at det også utgjør en risiko for barn og deres rettigheter. Det er snakk om privatliv, trygghet og sikkerhet. De fleste som utvikler AI, nevner sjelden noe om barn og deres rettigheter.

Unicef håper at både nasjonale myndigheter og private selskaper rundt omkring i verden kan bli mer bevisst på barnas rettigheter og behov ved kunstig intelligens.

Organisasjonen går inn for tre grunnleggende rettigheter for barn når det gjelder kunstig intelligens (AI):

- AI policies and systems should aim to protect children

- They should provide equitably for children’s needs and rights

- They should empower children to contribute to the development and use of AI

Barnevaktens tolkning av disse tre punktene oppsummeres slik: Beskyttelse, likhet og kunnskap. Kunstig intelligens skal beskytte barn, sørge for at barn seg i mellom ikke forskjellsbehandles og gjøre det mulig at barn får mer kunnskap om kunstig intelligens.

I følge en annen rapport fra Unicef er også de seks punktene nedenfor viktige i det videre arbeidet:

1. Uphold child rights

2. Prioritize children’s development and well-being

3. Protect and nurture children’s data agency

4. Ensure transparency, explainability and accountability for children

5. Prioritize safety, protection and AI literacy of children

6. Prioritize equity and inclusion of children

Her nevnes altså «transparency» som et viktig punkt, Barnevakten forstår det slik at det er viktig at barn, foreldre og andre får vite hvordan AI-en er skrudd sammen i det enkelte tilfelle. Og det bør forklares slik at også barn forstår.

Les mer om de seks punktene her

EU-regler om KI

EU har retningslinjer for kunstig intelligens; Artificial Intelligence Act. De går ut på at ulike KI-er rangeres etter hvor risikable de er for mennesker, og så har man ulike regler for disse. KI-er plasseres i fire kategorier:

- Ikke akseptabelt: Slike KI-er forbys. Eksempel: Sosial score slik man har i Kina.

- Høy risiko: Må gå gjennom mange sjekkpunkter før de kan sendes ut på markedet.

- Begrenset risiko: Må varsle brukerne. Eksempel: Deep fake, chatboter.

- Minimal risiko: Ingen restriksjoner.

Norge har planer om å kopiere denne loven fra EU. Regjeringen har i 2025 foreslått en KI-lov.

Microsofts seks idealer for bruk av kunstig intelligens

Microsoft har satt opp seks idealer for kunstig intelligens:

- Fairness: AI systems should treat all people fairly.

- Reliability & Safety: AI systems should perform reliably and safely.

- Privacy & Security: AI systems should be secure and respect privacy.

- Inclusiveness: AI systems should empower everyone and engage people.

- Transparency: AI systems should be understandable.

- Accountability: People should be accountable for AI systems.

Men det er umulig for foreldre å sjekke om den nye robotleken til barna er blitt laget med slike idealer eller om produsenten kun har gått etter billigste løsning som kan gi størst fortjeneste. En del leker og spill er for øvrig produsert i ikke-demokratiske land som kan ha en annen kulturell tilnærming til forbrukerrettigheter, barns rettigheter, personvern og så videre.

Barnevaktens synspunkter om kunstig intelligens

- Barnevakten mener at staten må opprette et offentlig tilsyn som kan regulere hva slags kunstig intelligens som barn blir utsatt for.

- Barnevakten mener også at man må sørge for at kunstig intelligens er trygg før teknologien gis til elevene.

- Barnevakten advarer mot at barn samtaler med KI-venner og KI-kjærester. Les mer: EU. Søksmål om selvmord.

(Denne artikkelen ble publisert 14. desember 2022 og har blitt oppdatert flere ganger, sist gang 18. november 2025. Hovedbilde øverst: Shutterstock / Sergii Kozii.)