Tips for å avsløre KI-videoer

Det er et stort problem at KI skaper millioner av falske videoer, spesielt ille er det når det spres falske nyheter, noe skremmende eller at identiteten til noen misbrukes.

Måned for måned blir KI-ene flinkere til å produsere videoer, du kan ikke lenger regne med å kunne avsløre dem som falske. Men inntil videre er det fremdeles noen tips som kan være til nytte ved de enkleste KI-ene.

DATO

Videoer som er publisert før 2023 er neppe laget av KI. Forsøk å finne ut datoen for første gangs publisering av videoen. Men husk at folk kan også jukse med datoer. På Youtube eller lignende video-tjenester, er det derimot vanskelig å jukse med publiseringsdatoen. Men ikke gå i fellen: En film fra 1950-tallet kan i dag vært gjennom KI. Det er publiseringsdatoen for den nye utgaven som er viktig å sjekke.

SETT PÅ PAUSE

Det er lettere å oppdage feil når videoen står stille. Feil kan for eksempel være at veimerkingen er svensk mens trafikkskiltene er norske.

LIKSOMBOKSTAVER

KI-er har tendens til å ha utydelige tekster som vises i bakgrunnen i motivet. For eksempel når motivet er et menneske som går langs en bygate, er gjerne butikkenes reklameplakater med liksom-tekst i bakgrunnen. Forsøk å se om det er ekte bokstaver som gir mening, uten stavefeil. Dersom det er ekte bokstaver, betyr ikke det nødvendigvis at selve videoen er ekte, kan kan like godt bety at KI-en er avansert.

KORTE SCENER

Nå i slutten av 2025 er kapasiteten til KI-ene slik at hver scene fremdeles er ganske kort. Når samme person opptrer i to scener, kan det hende at det er små forskjeller på klær, ansikt eller omgivelser.

KILDEN

Sjekk om kilden til videoen er til å stole på. Dette er lettere sagt enn gjort. Du må i tilfelle først finne samme video liggende hos kilden. Deretter må du sjekke om kilden er troverdig. Men hvordan sjekker man om en kide er troverdig? Du kan spørre KI, selv om KI ikke alltid er til å stole på. Eller så må du rett og slett gå gjennom hva som ellers er lagt ut av saker hos kilden.

Det er selvsagt umulig å sjekke kilder til alle videoer som farer forbi i feeden, så du og barna kan også vurdere å trappe ned på enkelte apper eller kanaler som viser seg å inneholde mange løgner.

EKTE PRESSE

Seriøse aviser har sine egne reportere ute for å filme og har også et nettverk av samarbeidspartnere som de stoler på. I utgangspunkter har derfor videoer i aviser høyere troverdighet, selv om også aviser kan vinkle stoffet eller gjøre feil.

Men ikke la deg lure av at videoen viser et nyhetsstudio eller en journalist med mikrofon ute i gatene, det kan fremdeles være en falsk video. Det er kanalen som du ser videoen i, som kan gi mer eller mindre troverdighet. Ser du videoen i avisens egen kanal?

Dersom du ser noe utrolig på nettet, for eksempel at det har landet en UFO foran Stortinget, kan du sjekke avisene om det er flere som har rapportert en så stor nyhet. Er det ingen seriøse nyhetssteder som forteller om UFO-en, da er det ganske sikkert en falsk nyhet.

Det er ikke dermed sagt at det er bare redaktørstyrte medier man bør lytte til. Ute på nettet er det enkeltpersoner eller organisasjoner som kan formidle viktig informasjon som er sann.

VANNMERKE

Enkelte KI-er legger inn en liten logo i videoen, dette for å advare folk om at videoen er laget av KI. For eksempel Sora 2 har en liten logo som flytter seg rundt i videoen. Hensikten med at logoen beveger seg, er at folk ikke skal kunne beskjære videoen og vise kun den delen som ikke har logo.

Men det er mange KI-er som ikke legger inn logo, så du kan ikke stole på en video bare fordi den ikke har KI-varsling. Det finnes også KI-er som brukes til å fjerne logoer i andre KI-videoer.

Et triks som noen bruker for å lure deg, er å legge sin egen logo eller en emoji oppå KI-logoen, for å skjule KI-logoen. Ser du en video som har smilefjes eller andre emojier, så øker mistanken om at videoen er laget av KI.

Det finnes også KI-er som legger inn usynlige logoer, det som kalles vannmerke. Da an ekspreter som har avtale med KI-selskapet kikke under panseret i bildet eller videoen og se om det er et vannmerke der.

LOGISKE FEIL

Du kan noen ganger oppdage at KI-en har gjort logiske tabber. For eksempel kan en person spasere bak et tre uten å komme frem igjen på den andre siden av stammen. Eller skyggene går i ulike retninger, eller skoene skifter farge midt i scenen.

ULIK SKARPHET

Noen KI-videoer går ut på å ta ansiktet til en person og lime det på hodet til en annen person. Da kan du noen ganger se at ansiktet er skarpere enn for eksempel lua.

LYTT!

Et intervjuopptak i et studio har lik lyd hele veien. Dagens KI-er kan surre med ulik romklang eller ulik diskant eller bass. Ofte kan lyden være rett og slett dårlig.

DE SIER DET HASTER

Ser du en video der budskapet er at det haster at du må gjøre noe, bør du tenke deg om, det kan hende det er en falsk video.

IKKE MENNESKELIG OPPFØRSEL

En del KI-bilder er fremdeles enkle å avsløre fordi KI-ene ikke er avanserte nok, eller fordi ledeteksten ikke var presis nok. Se på bildet under som ble produsert av KI i dag. Vi ba en KI lage bilde av elever som ser på skjermer med forstørrelsesglass. Men vi presiserte ikke at elevene skulle se på den riktige siden av skjermen. KI-en lot derfor flere elever studere baksidene av skjermene. Man kan le av dette, men hensikten med bildet var å zoome inn for å se etter mistenkelige tegn.

Nedenfor har vi zoomet inn på øret til eleven foran til venstre:

Håret foran og bak øret er uskarpt. Men kanten av øret er skarp. Slik vil ikke et ekte kamera oppføre seg.

TEST DEG SELV

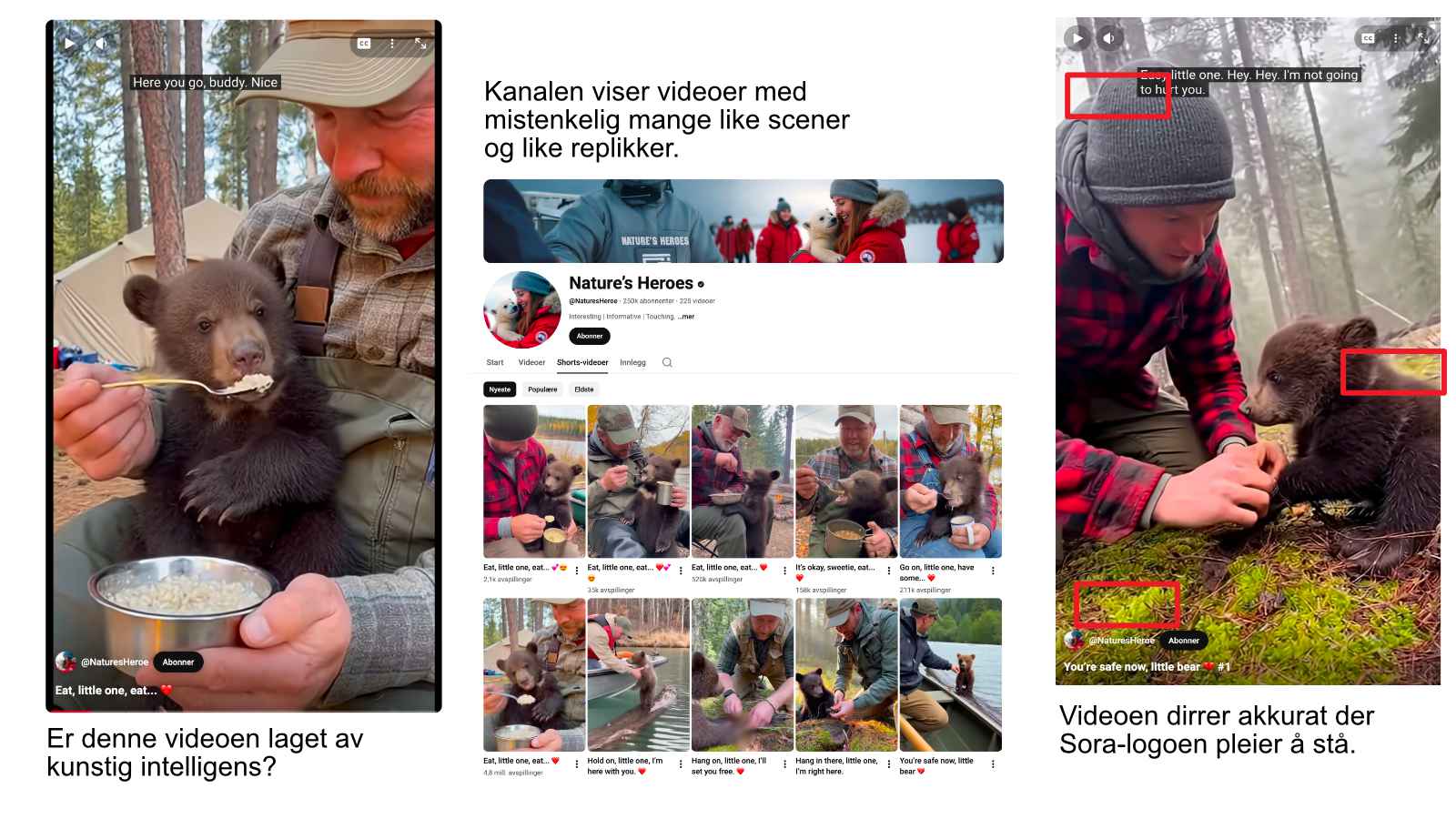

En kort video på Youtube viser en mann som mater en bjørneunge. Man får en følelse av at det er en KI-video, men det er ikke lett å sette fingeren på hva som er feil. Kommentarfeltet viser at folk tror det er en ekte video. Hva tror du?

Lyden er skarp og flat slik det gjerne er i en del KI-videoer nå mot slutten av 2025. Mannen sier at bamseungen får grøt på snuten og at det skal tørkes bort etterpå. Men det er ikke noe grøt på snuten, så replikken er antagelig skrevet inn på forhånd i et manus.

Et tips er å sjekke kanalen og se om det er mange KI-videoer der. Og ja, denne bamsevideoen finnes i mange varianter i kanalen, med ulike menn som bruker noen av de samme replikkene. Det er også ulike videoer av samme hendelser, med nær samme manus, men der klær, båt, vær og skog er ulike.

I noen av videoene kan du se at et utvalgt område «skjelver», det betyr at produsentene har brukt KI for å skjule KI-logoen til Sora. Nok et tegn på at bamsevideoen ikke er ekte.

Kikker du mer i kanalen, ser du at det ligger flere opplagte KI-videoer der. I en av videoene påstår man at en ubåt dukket opp i en ørken og at mange lamaer stilte seg opp i sirkel rundt ubåten. En opplagt falsk historie, som igjen svekker bamsevideoen.

Er du usikker på om du står overfor en KI-video, kan du altså ta en kikk i kanalen og se om den er seriøs eller ikke.

EKSPERTER HAR FLERE TRIKS FOR Å AVSLØRE KI

KI-er er trent opp på noe som er todimensjonalt, altså bilder og filmer. Det finnes dataprogrammer som kan avsløre KI-videoer som bryter med geometri som finnes i den virkelige verden, for eksempel forsvinningspunkt. Men det er ikke alltid disse programmene konkluderer korrekt.

Slike programmer har flere grep som benyttes for å avsløre falske videoer. Hver KI pakker sammen bildet eller filmen til en fil på sin unike måte, til forskjell fra hvordan mobiltelefoner pakker sammen filer eller hvordan Photoshop pakker sammen filer. Eksperter kan ved zoome inn på de minste detaljene i bildet, videoen eller lydfilen, og oppdage pakkemønsteret, og på den måten avsløre at filen kommer fra en bestem KI.

Her er eksempler på to videoer som er pakket på ulike måter:

I bildet over er alle firkantene like store. I bildet under er det firkanter inne i firkantene:

Det er Barnevakten som pakket disse to bildene ved å zoome inn på bildet øverst på siden, som er hentet fra en KI-video. Det nederste bildet har fått kraftig jpg- komprimering. Vi antar at det er slike tegn ekspertene kan tolke.

DET ER ET STORT MEN

Selv om du har fått noen tips her, kan du ikke regne med at du makter å avsløre alle falske videoer. Den tekniske utviklingen har høy fart. Det du lærte i dag, kan være utdatert i morgen.

Skroller du passivt og ser tusener av korte klipp fare forbi i feeden, kan ditt virkelighetsbilde forvrenges.

Så hva i all verden skal man gjøre? Vel, man må velge kanaler med omhu.