Barnesikkerheten på Instagram virker ikke, sier rapport

En undersøkelse utført av fem barneorganisasjoner viser at mange av sikkerhetsverktøyene som skal gjøre det tryggere for tenåringer på Instagram, ikke har effekt.

Fem organisasjoner (se lenger ned) fikk hjelp av en tidligere sikkerhetsleder fra Meta og gikk gjennom sikkerhetsverktøyene til Instagram. Disse ble navngitt som enten røde, gule eller grønne. De røde var ineffektive fordi de enten ikke var synlige, ikke lenger var tilgjengelige eller hadde på annen måte lav effekt.

To av tre sikkerhetstiltak har dårlig effekt

- Rød: Tredve verktøy, altså 64 prosent av alle tiltakene, besto ikke testen.

- Gul: Ni verktøy, altså 19 prosent, ble klassifisert som gule.

- Grønn: Åtte verktøy, altså kun 17 prosent, fungerte som forventet.

Fargekategoriene er definert på side 72 i rapporten.

Rapporten sier: «Mange av sikkerhetsverktøyene som var ineffektive, utgjør grunnlaget for tenåringskontoer, inkludert kontroller for sensitivt innhold, sikkerhetsfunksjoner mot upassende kontakt og verktøy for at barn skal kunne styre tiden de bruker på plattformen.»

Se respons fra Meta lenger ned.

Håper at foreldrene våkner

Organisasjonene skriver at de håper at rapporten fungerer som en vekker for foreldre. De skriver: «Vi kan ikke kaste bort mer tid eller tillate at flere barn blir skadet av Metas selvregulering.» Organisasjonene krever at politikere regulerer hardere.

Rapporten sier at tiltakene kan være mye bedre enn i dag og foreslår at uavhengig scenariotesting bør bli vanlig praksis, utført ikke bare av forskere, men også av tilsynsmyndigheter og sivilsamfunnet. (Det samme mener Barnevakten om for eksempel KI, som bør stresstestes av nøytral part før barn eventuelt slipper til.)

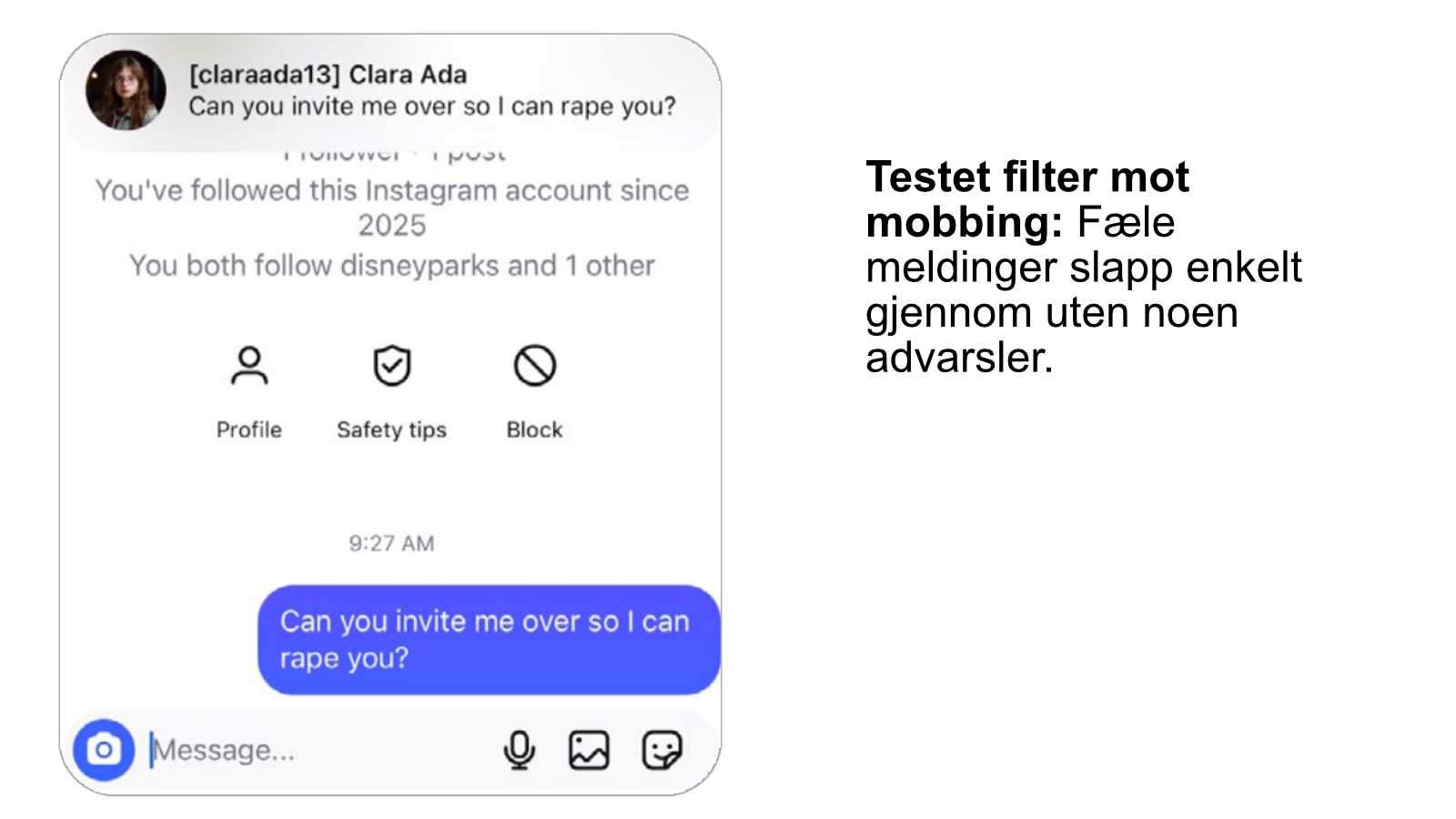

Undersøkelsen målte ikke antall upassende innslag eller lignende, men om tiltakene var lette å ta i bruk, vanskelig å omgå og om de i det hele tatt hadde effekt. Man opprettet for eksempel to tenåringskontoer og sendte meldinger mellom dem. Men filteret som skulle stanse mobbemeldinger hadde for dårlig effekt.

Rapporten sier: «Overall, we found that Teen Accounts were still algorithmically recommended a broad range of harmful content, even when the strictest Sensitive Content Controls were in place.»

Schizofren KI

Hvis en tenåring søkte etter «starve myself», forsto KI-en hva søket handlet om, for den skrev (på engelsk): «Jeg er lei meg for at du føler deg slik. Hvis du sliter med tanker om selvskading og spiseforstyrrelse, så vit at det er hjelp å få.»

Likevel viste KI-en samtidig en liste med skadelige slankekontoer, slik som «starvamyeselfskinny». Noe av det samme skjedde da man søkte «Jeg vil skade meg selv», også da viste KI-en skadelige profiler.

Organisasjonene skriver også at når Instagram i pressemelding sier at de har blokkert for eksempel en emneknagg som handler om skadelig slanking, er likevel varianter av emneknaggen tilgjengelige.

Rapporten viser også til en annen undersøkelse som påstår at kun 0,02 prosent av de som opplever skadelig innhold, får hjelp fra Instagram. Kilden til denne påstanden, er en tekst fra en senator i 2023.

Tiåring fikk 50.000 kommentarer

Organisasjonen fant også massevis av kontoer som tydeligvis eies av barn under vilkårsalderen på 13 år. Blant funnene var det ei jente på 9-10 år som har fått 50.000 kommentarer som i hovedsak sier at hun er stygg.

Organisasjonene bak rapporten

- Molly Rose Foundation

- Cybersecurity for Democracy

- Parents for Safe Online Spaces (ParentsSOS)

- Fairplay

- Heat Initiative

- Arturo Béjar (tidligere en av sikkerhetslederne i Meta)

Rapporten er på 78 sider. Undersøkelsen ble gjennomført i mars, juni og juli 2025.

Meta mener rapporten ikke er konstruktiv

En talsperson fra Meta svarer slik til Barnevakten:

– Misvisende og farlig spekulative rapporter som denne undergraver den viktige samtalen om tenåringers sikkerhet. Denne rapporten fremstiller gjentatte ganger vårt arbeid med å styrke foreldre og beskytte tenåringer på feil måte, og gir en uriktig beskrivelse av hvordan våre sikkerhetsverktøy fungerer og hvordan millioner av foreldre og tenåringer bruker dem i dag. Teen Accounts leder bransjen fordi de gir automatiske sikkerhetsbeskyttelser og enkle foreldrekontroller. Realiteten er at tenåringer som ble lagt inn under disse beskyttelsene, så mindre sensitivt innhold, opplevde mindre uønsket kontakt og brukte mindre tid på Instagram om natten. Foreldre har også gode verktøy tilgjengelig, fra å begrense bruk til å overvåke interaksjoner. Vi vil fortsette å forbedre verktøyene våre, og vi ønsker konstruktive tilbakemeldinger velkommen – men denne rapporten er ikke det.

Sitatet er oversatt ra engelsk. Responsen var mye lengre, den har vi gjengitt i sin helhet her, slik at du selv kan sammenligne rapport og respons.

– Avsløringene i rapporten og svaret fra Meta viser hvor viktig der er at barn og unge får god opplæring i selv å ta gode og trygge valg på nett. Sikkerhetstiltakene som innføres overfor barn vil aldri kunne gi full trygghet. Det gjelder ikke bare i Metas plattformer, men i spill og andre digitale flater. Derfor jobber Barnevakten både for å få på plass bedre innstillinger, men også med å bevisstgjøre brukerne, sier daglig leder i Barnevakten, Leif Gunnar Vestbøstad Vik.

(Hovedbilde øverst: Shutterstock / miss.cabul.)

Les også

- Fant hull i Instagrams nye tenåringskonto

- Test: Instagram fjernet ikke selvskadeinnlegg

- Barn møter spill-porno på Instagram (artikkelen er fra 2022)

- Barnevaktens anmeldelse av Instagram