Google og Meta skal sammen bekjempe nettovergrep mot barn

Flere tech-giganter skal dele data med hverandre for å oppdage overgrepsbilder av barn. Det nye samarbeidet kalles Lantern.

Det nye samarbeidet mellom Meta og Google skal ikke bare lete etter overgrepsbilder av barn, men skal også forsøke å stanse pågående aktivitet fra overgripere.

Meta eier store sosiale medier som Instagram og Facebook. Google eier blant annet e-post-tjenesten G-mail.

Selskapet Tech Coalition sørger for infrastrukturen mellom tech-gigantene slik at det er mulig å dele med hverandre mistenkelig brukeroppførsel.

Det er CSAM som skal bekjempes, det står for «Online child sexual exploitation and abuse». Tech Coalition skriver at det hele tiden er 750.000 personer som forsøker å knytte til seg barn på nettet for å utføre overgrep mot dem.

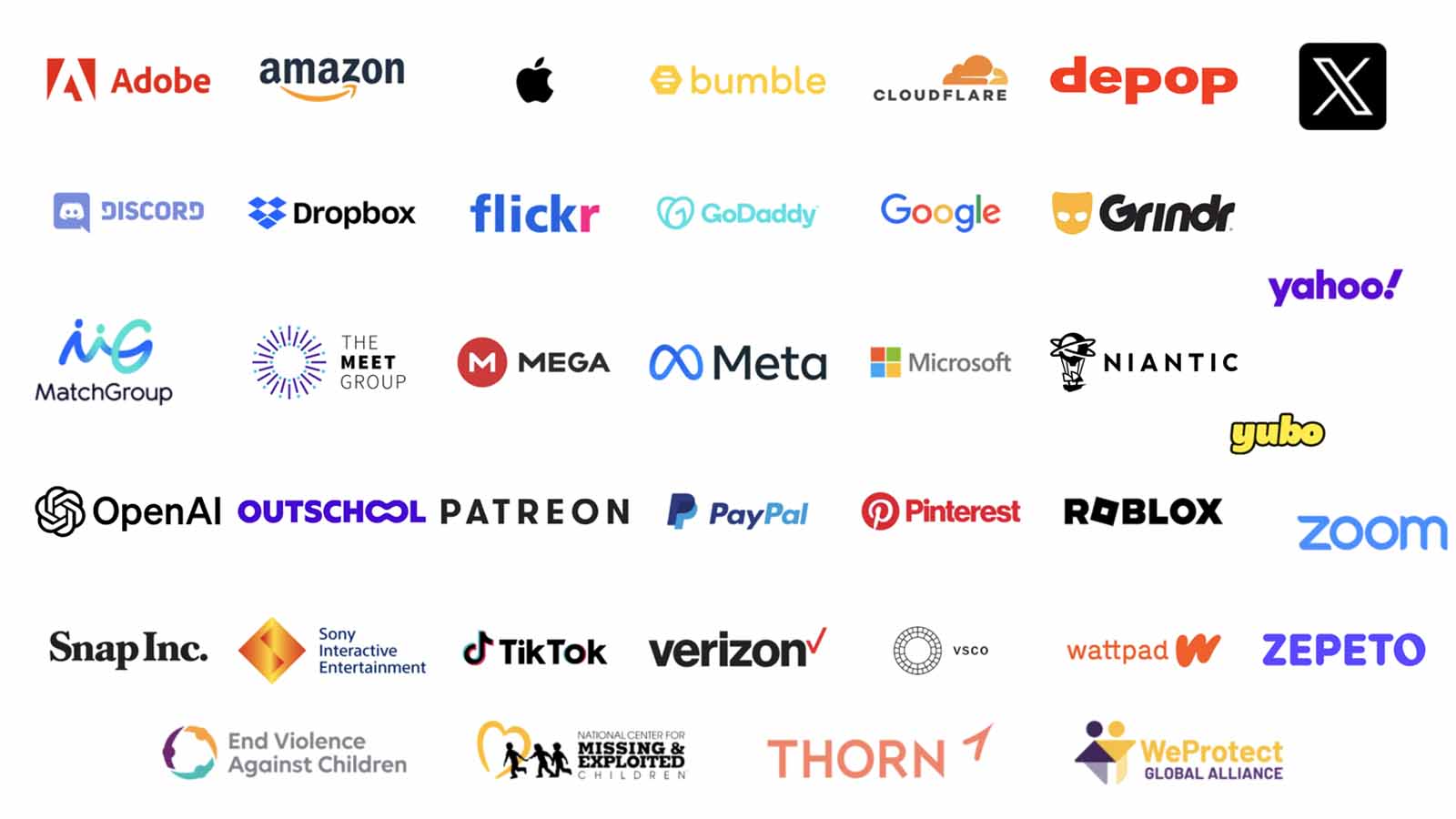

Tech Coalition har mange medlemmer, slik som Amazon, Snapchat, Roblox og Zoom, hvert medlem må forplikte seg til å ha tiltak i kampen mot overgrep mot barn. Men tiltakene er ikke nødvendigvis identiske. Så langt Barnevakten forstår, er det foreløpig bare et fåtall av dataselskapene som er med i den nye ordningen Lantern.

En viktig rolle har National Center for Missing & Exploited Children (NCMEC). Det er den organisasjonen som sitter på «fingeravtrykkene» til overgrepsbilder som er blitt avslørt.

Når en tech-gigant skal sjekke om en bruker deler eller lagrer overgrepsbilder, er et av tiltakene å sjekke bildene mot arkivet til NCMEC. Dette kan skje automatisk uten å flytte filene eller ta kopi av dem, man sammenligner bare en matematisk kode, et slags digitalt fingeravtrykk.

Dataselskapene bruker også kunstig intelligens og manuell kontroll.

Meta skriver at selskapet benytter en teknologier som heter Microsoft’s PhotoDNA og Meta’s PDQ. Førstnevnte lager digitale fingeravtrykk av bilder, en slik signatur kalles «hash». Sistnevnte er et system som kan finner bilder som er identiske. Teknikken virker også på videoer.

Hva går Lantern ut på?

Lantern er det første systemet for fordeling av data på tvers av plattformer når det gjelder tiltak mot overgrep mot barn.

Innledningen til et overgrep starter gjerne i kanaler som barn og unge benytter og som de føler seg trygge i. Overgriperen kan samtale med barnet i ulike apper, hvert appselskap ser da bare litt av kommunikasjonen og det er vanskelig å avsløre overgriperen.

For å få flere puslebiter på plass, må ulike selskaper samarbeide. Det er dette Lantern går ut på, det er en infrastruktur som gjør det enklere for tech-selskapene å dele mistenkelig oppførsel, altså mistenkelige data.

Signaler kan være misbruk av e-postadresser, brukernavn, hasher, nøkkelord som brukes til grooming, deling av CSAM-bilder og lignende.

Ett signal alene er ikke nok, det er ikke nødvendigvis et bevis på overgrep. Men ved å samle signaler fra flere plattformer kan overgrep avsløres, til og med mens det pågår.

Lantern-programmet kan da avsløre mange flere overgripere, man kan også lære raskere hvordan overgripere opererer. Flere tech-selskaper kommer antagelig til å koble seg på Lantern etterhvert.

Kan Lantern gå utover personvernet?

Systemer som skal sjekke om folk holder seg innenfor lovverk og appvilkår, kan noen ganger ta feil. Generelt er ikke uvanlig at sosiale medier stenger en konto uten at brukeren forstår hvorfor, dette fordi kunstig intelligens og andre dataprogrammer har overtatt styringen og har mistolket en kommentar eller et bilde som rasistisk eller noe slikt.

Man kan derfor tenke seg at også Lantern og lignende tiltak mot overgrep kan ta feil enkelte ganger. Tiden vil vise hvor ofte det vil skje og hvordan man da kan sikre at uskyldige blir håndtert med minst mulig skade.

(Hovedbilde øverst: Shutterstock / Ground Picture.)