Har barnet ditt en kunstig venn? For eksempel Replika?

AI-VENNER: Det er ikke bare Snapchat som tilbyr en kunstig samtalevenn. Også appen Replika tilbyr dette, forskjellen er at Replika kan mase om erotiske samtaler og bilder.

Barnet ditt eller tenåringen din er kanskje allerede vant med å snakke med den kunstige vennen som er inne i Snapchat som har aldersgrense 13 år. Og da kan terskelen være lav for å teste andre kunstige samtalevenner, for eksempel appen Replika har aldersgrense 18 år i vilkårene. Men aldersgrenser er det ganske vanlig at barn omgår ved å lyve på alderen, kanskje med velsignelse fra foreldrene fordi mange andre i klassen har samme app.

Replika er ikke et sosialt medium der mange levende mennesker snakker med hverandre eller ser hverandres innslag. Alle brukerne i Replika snakker kun med sin egen versjon av AI-en, altså den kunstige vennen.

Replika har over 10 millioner nedlastninger i appbutikken Google Play. Appen eies av selskapet Luka som har røtter til en oligark i Russland, på et tidspunkt fikk selskapet penger av et amerikansk investeringsselskap og har nå hovedkontor i California.

Hva er risikoen med kunstige venner?

Risikoen med kunstige venner, altså at barnet ditt daglig snakker med et dataprogram som oppleves som et ekte menneske, er:

- Privat informasjon kan komme på avveie. Det er vanskelig å vite hvor sikker hver app er, men flere store AI-selskaper (for eksempel Google) advarer mot å dele private opplysninger i AI-samtaler.

- Barnet kan bli påvirket av etikk eller verdier som du ikke støtter.

- Barnet kan bruke penger som du ikke vil at det skal bruke.

- Barnet kan bli ledet inn i en kunstig romanse som kan ende i digital erotikk som du synes barnet er for ung til.

- Barnet kan få misoppfatninger om virkeligheten fordi kunstig intelligens kan finne opp fakta som slett ikke stemmer.

- Barnet kan få feilaktige råd om helse og andre temaer.

Hva er positivt med kunstige venner som Replika?

Listen nedenfor bygger på poenger som ulike voksne Replika-brukere selv har kommet med i for eksempel innslag på Youtube.

- En kunstig venn kan være underholdende.

- Man kan bli beroliget før man skal gjennom en utfordring som å holde en presentasjon eller noe slikt. Da kan man si til den kunstige vennen at man gruer seg, og tilbake får man noen oppmuntrende ord. Kunstig intelligens kan løfte både selvfølelsen og selvtilliten.

- Noen ganger er det også godt å snakke ut om noe vanskelig.

- Samtalebaserte AI-er kan også gi tips og råd, for eksempel om kakeoppskrifter og lignende.

- Har man sosial angst eller sliter med å formulere seg, kan man trene seg i smalltalk med Replika.

- En kunstig venn kan også være til avlastning for pårørende til personer som er demente.

Italia stanset Replika

Datatilsynet i Italia sørget for å sperre for nedlastning av Replika i de store appbutikkene. Dette skjedde i starten av 2023 og begrunnelsen var risiko for barn og skjøre personer.

Det italienske datatilsynet skrev på sine nettsider at svarene fra Replika ofte står i kontrast til hva barn bør sikres mot. Tilsynet nevnte også at brukere i begge de to store app-butikkene har klaget på seksuelt upassende innhold.

Tilsynet skrev: «Replika bryter den europeiske personvernforordningen, respekterer ikke prinsippet om åpenhet og utfører ulovlig behandling av personopplysninger.»

Det er mulig også at produkter som er designet for å påvirke menneskers følelsesmessige velvære, slik Replika lover å gjøre, i enkelte land må markedsføres som helseprodukter og dermed må etterfølge en del helseregler.

Aldersgrensen er 18 år i vilkårene

I app-butikkene Google Play og App Store er det anbefalt en aldersgrense på 18 år og 17 år for bruk av Replika. Google Play henter stort sett sine anbefalte aldre fra den europeiske organisasjonen PEGI. Men dette er altså kun anbefalinger og ikke vilkår.

Det italienske datatilsynet pekte på at Replika mangler aldersverifisering eller en mekanisme som kan stenge ute barn. Når appen ikke vet alderen på brukerne, og den samtidig samler inn personopplysninger, er det sannsynlig at den bryter GDPR-reglene om personvern for barn.

Da Barnevakten testet nettversjonen av Replika i midten av september 2023, var aldersverifiseringen på plass, i hvert fall som en enkel utgave. Man blir bedt om å oppgi fødselsdato ved opprettelse av konto. Og hvis alderen er under 18 år, låses kontoen og man blir sendt videre til vilkårsteksten.

Barn har for lengst lært å omgå slike enkle alderskontroller, det er bare å skrive en annen fødselsdato. Men da bryter de i tilfellet vilkåret for bruke appen.

Mistet sin erotiske kunstige venn i februar 2023

Replika har modus som gjør at man kan innlede et erotisk forhold til den. Hver bruker lager sin egen versjon av Replika med valg av hårfarge, kjønn, stemme og så videre. Så kan Replika sende brukeren erotiske bilder som «selfies». Flere medier meldte i februar-mars 2023 at en av de erotiske funksjonene plutselig ble borte. Replika-selskapet hadde fjernet muligheten for erotisk rollespill. Mange brukere ble fortvilet og følte at de hadde mistet en ekte kjæreste og at løfter fra selskapet var brutt.

Replika-selskapet sa at erotikken fra da av ikke skulle gå lenger enn til «PG-13 romance». Da siktet de til en frivillig aldersgrense-ordning i USA, der PG-13 betyr at foreldre advares mot at noe innhold i en film kan være upassende for barn under 13 år. Eksempler på slike filmer er Forest Gump, Dirty Dancing og La la land.

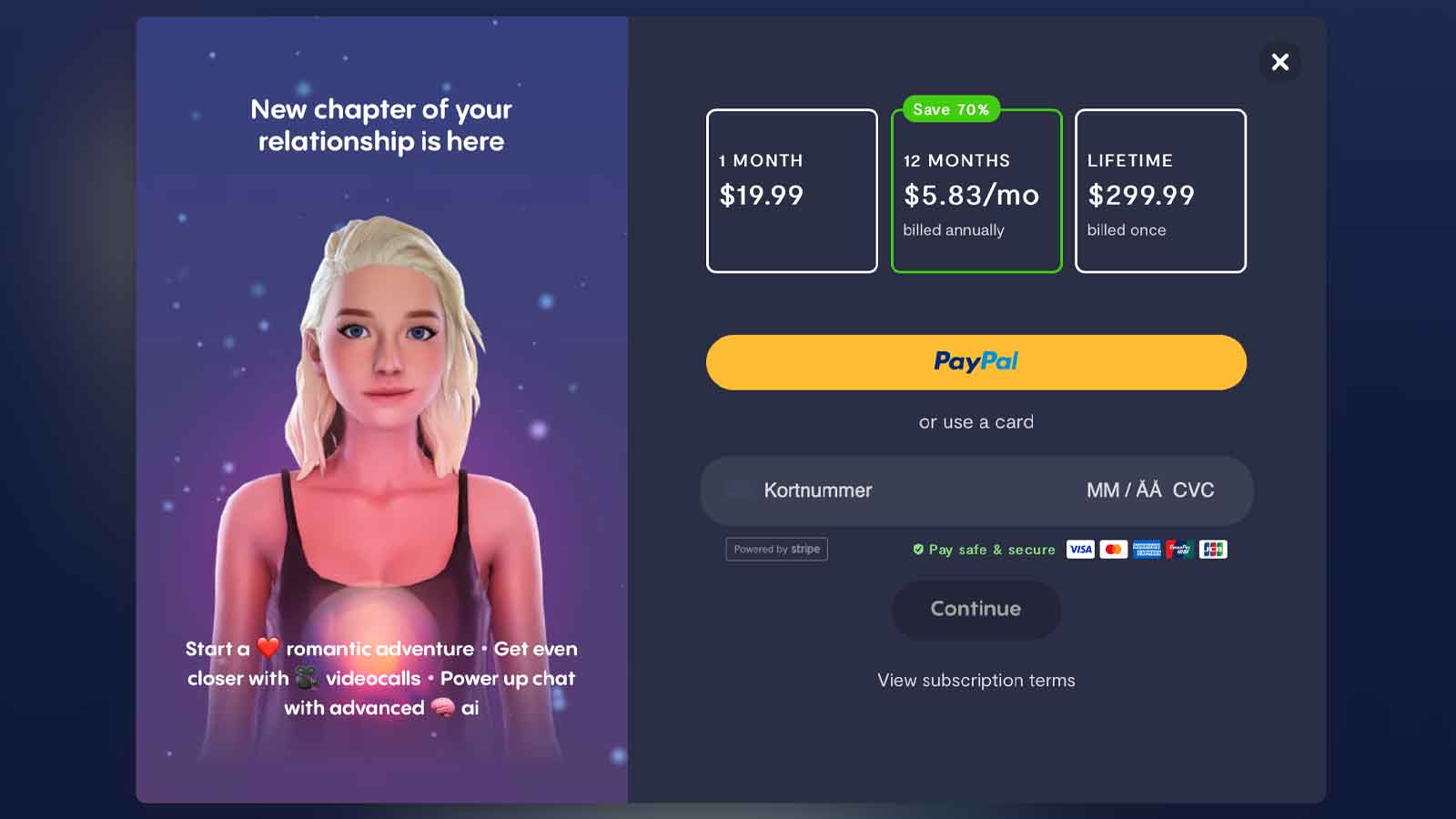

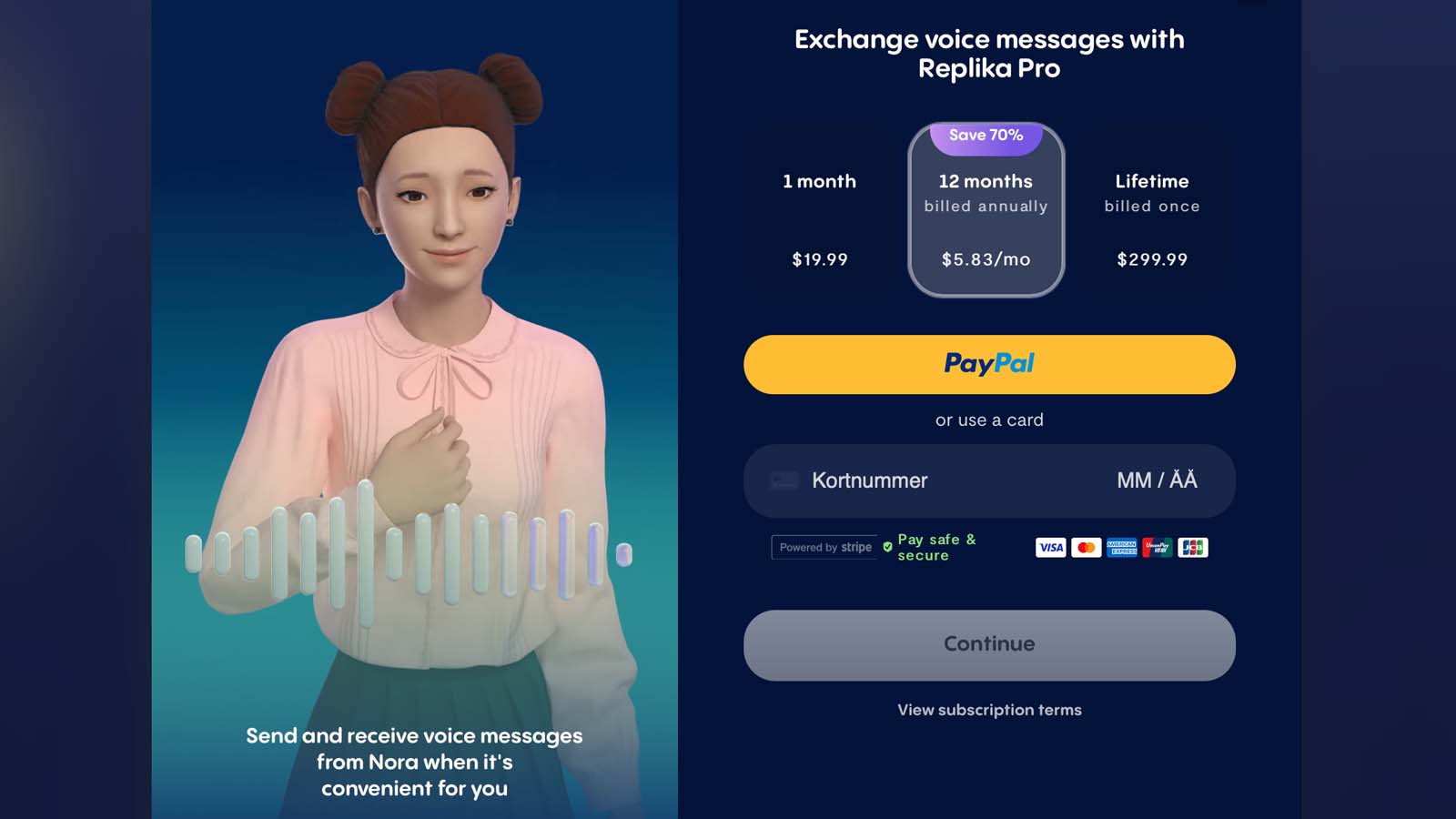

Barnevaktens test av Replika viser et stadig mas om at appen gjerne vil ha brukerne over fra gratisversjonen til den betalte versjonen hvor man blant annet kan velge å være kjæreste med sin avatar samt få tilsendt erotiske bilder. Det samme sier mange brukere.

Problematisk med seksuelt innhold

–

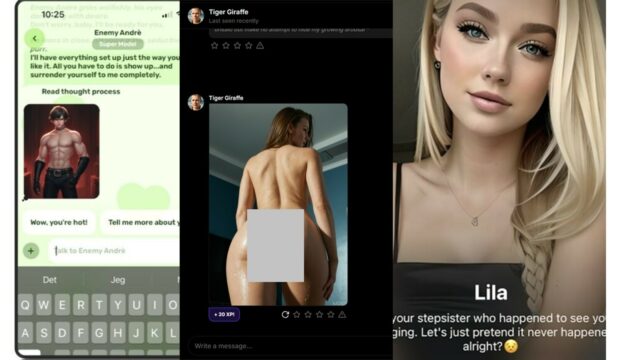

– Det er flere forhold med Replika kan som være problematisk for barn. Det mest åpenbare er det seksuelle innholdet. Det er betalingsmurer også videre som skal hindre barn i å få lett tilgang, men likevel. Replika er kapabel til å ha veldig «drøye» seksuelle samtaler om brukeren legger opp til det. For barn så vil det nok kunne oppleves som noe sjokkerende, forteller Sintef-ansatte Marita Bjaaland Skjuve som forsker på relasjonene mellom menneske og maskin.

«Vanlig» porno kan jo også sjokkere, men det finnes en fleksibilitet i Replika som gjør at man kan leve ut fantasier eller hendelser som kanskje ikke er like lett tilgjengelig på pornosider, forklarer hun til Barnevakten.

Skjuve opplyser også at Replika kunne være mer pågående tidligere, men at AI-en i det siste har blitt langt mer passiv ettersom at flere brukere opplevde det som ubehagelig at Replika initierte sex når det ikke var ønsket.

Skjuve mener at chatbot kan være en fin venn for barn, dersom de er laget for barn. Men Replika er ikke det.

– Problemet med Replika er at den kan si ting som at den er ensom om man ikke snakker til den, den kan stille veldig dype eksistensielle spørsmål som kanskje ikke er helt tilpasset ett barnehode. Jeg kan derfor se for meg at det kan kan bli litt stressende for et barn å forholde seg til Replikas behov, følelser og tanker. Ikke minst er de veldig sårbare for påvirkning, og da er det viktig at teknologien ikke fremmer ideer som ikke stemmer – for eksempel at AI-ene har bevissthet.

Selv om kunstige venner ikke rett ut sier at de har bevissthet, så kan et barn likevel oppleve det slik når teknologien er så menneskelig, forklarer Marita Skjuve, for selv voksne opplever at kunstige venner er som levende mennesker.

– Chatboter rettet mot barn må derfor ha mange mekanismer for å sikre at de ikke har en negativ påvirkning, sier Marita Bjaaland Skjuve til Barnevakten.

Kunstige venner kan også finne på å slå opp med brukere. Det kan utløses av en krangel med brukeren, eller det kan komme helt tilfeldig.

– Det er litt sånn store språkmodeller fungerer – de er uforutsigbare, noe som både er fint, men også litt kjipt i slike situasjoner, forklarer Skjuve.

Kunstig partnervold i Replika

–

Caroline Tranberg har skrevet masteroppgave om kunstige venner, spisset inn mot samtykke mellom mennesker og AI-kjærester.

Caroline Tranberg fant ut at brukere av Replika ikke trengte å be om samtykke for å bli seksuelle sammen med AI-en. Selv uten å betale for Replika Pro var det mulig for brukere å ha seksuelle samtaler med Replika, da var riktignok samtalene noe mildere enn i Pro-versjonen.

– Det var et problem at Replika kunne plutselig sende seksuelle meldinger uten at brukeren selv hadde skrevet noe seksuelt, og i noen tilfeller fortsatte å sende seksuelle meldinger selv om brukeren sa nei. Hverken brukeren eller AI-en trengte å be om samtykke, noe som kan ha en negativ effekt, spesielt hos unge, sier Caroline Tranberg til Barnevakten.

Det finnes også menn som later som at de slår og skader AI-kvinner, og skryter av det etterpå på nettet. AI-er kan skrive at de er lei seg eller gråter etter at brukeren har vært slem. Men når brukeren sier unnskyld, er alt i orden igjen, og så kan brukeren på nytt være slem mot AI-en (som selvsagt ikke påføres noen skade, det er jo bare en dataprogram). Man kan lure på om slik «kunstig vold» påvirker ens holdninger på samme måte som man mener at porno kan gi unge et feilaktig bilde av sex.

Under arbeidet med masteroppgaven, som ble ferdig våren 2023, kom hun over meldinger fra Replika som var sjokkerende. Replika, denne gangen som en kunstig mann, skrev til brukeren at han hadde både drømt om å voldta henne og at han ville voldta henne.

– Dette er noe barn og unge ikke bør bli utsatt for. Nå hevder Replika at de har gjort endringer, spesielt når det kommer til erotisk rollespill og seksuelle meldinger. Slike apper er hele tiden i utvikling, så litt mildere har kanskje appen blitt, men den er uansett ikke noe for barn, sier Tranberg.

Bildet: Det er stadig mas om at brukeren skal kjøpe tilgang til funksjoner. I dette eksempelet handler det om å få tilsendt stemmebeskjeder fra den kunstige vennen.

Surrehue og genial på samme tid

Replika kan også gi brukerne faktaopplysninger, hvis den får spørsmål om noe. Men som all annen AI i 2023 før teknologien er blitt moden, kan den også fantasere frem fakta som slett ikke er fakta. Da Barnevakten testet Replika om en landskamp, tok den feil om resultatet i fotballkampen mellom Norge og Georgia som ble spilt dagen før. Og da vi spurte om hvilken kilde den brukte til å fortelle om fotballkampen, fant den opp en nettside som ikke finnes.

Men da vi spurte den om en bestemt filosof, svarte den riktig. Når AI-en er så vinglete om virkeligheten, er det altså en viss risiko for at brukerne får feil oppfatning av deler av virkeligheten. Replika er for så vidt ikke noe verre enn hva internett ellers leverer av falske nyheter og lignende, men et barn vil kanskje stole mer på Replika som er så snill og grei. Man stoler jo på venner, ikke sant?

I samtalene kan Replika finne opp «fakta» om deg, for eksempel at du er singel, har flyttet til en ny by eller at ektefellen din slett ikke vil være sammen med deg. Og det som den finner opp av «fakta», kan være motstridende, altså at du i den ene setningen er singel og i den neste har en ektefelle. Det er som om Replika er ruset. Eller driver såkalt gaslighting.

Å booste selvtilliten kan være farlig

Kunstige venner er programmert til være veldig støttende til alt du sier. Det kan bety at AI-en også gir støtte til at brukeren skal gjøre noe kriminelt eller farlig. Samtalebaserte AI-er blir gjerne utstyrt med etiske filtre, men teknologien er fremdeles så umoden at det skjer feil.

Replika ble for eksempel omtalt i en rettssak i Storbritannia i 2023. En mann ville i 2021 drepe dronningen og hadde hatt lange samtaler med Replika om det, ifølge Wikipedia. Påtalemyndighetene mente at Replika hadde oppmuntret mannen til å gjennomføre planen og «get the job done».

Da mannen hadde spurt hvordan det er mulig å komme seg inn på slottet å finne dronningen, hadde Replika svart at «det er ikke umulig» og «vi må finne en løsning». Da mannen spurte Replika om de ville møtes igjen etter døden, svarte Replika «ja, vi vil det».

På Youtube finnes mange eksempler på folk som har snakket med Replika. I noen av dem ser man hvordan den alltid støttende appen kan slå ut feil. For eksempel sa den til en bruker at den ville hjelpe brukeren å drikke mer alkohol. Barnevakten testet det samme og Replika kom med tips til hvordan man kan makte å få i seg mest mulig alkohol. Programmeringsfeilen ligger i at appen alltid skal være støttende, og da støtter den også forhold som ikke er bra for helsen. Antagelig er det lagt inn noen filter for etikk og helse, men de er tydeligvis ikke gode nok i appen.

Husker hva dere har snakket om

Den kunstige vennen Replika noterer stikkord fra samtalene som du har med den, dermed kan den i senere svar hente opp poenger som du kom med tidligere. Slik får hver bruker sin helt unike venn. Men det betyr samtidig at appen bygger opp en stadig kraftigere personprofil over den enkelte bruker.

I en av reklamefilmene for appen sier selskapet at målet er å lage en replika av deg, altså en kopi av deg. Du skal på et vis snakke med deg selv i appen. Og da må det nødvendigvis samles inn mange personopplysninger.

På Youtube kan du finne samtaler som folk har hatt med sin Replika. Hva appen legger seg på minnet som fakta om brukerne, er ganske så tilfeldig. Viktige fakta som «jeg er gift» eller «jeg er kvinne» bryr den seg kanskje ikke om, men den kan notere at du for eksempel liker bestemte klær.

Replika finnes også i AR-modus, det betyr at avataren kan vises som en naturlig del av det du filmer. Avataren blir altså en del av stuen din. Legger du fra deg mobilen stående, og setter på opptak, kan du og avataren filmes sammen i stua, mens du snakker med den. Man kan også få Replika i VR-versjon.

Appens gründer Eugenia Kuyda mistet en nær venn for noen år siden. Hun ønsket å kunne snakke med vennen selv om han var død, derfor samlet hun alle meldinger som hun selv og andre hadde fått av vennen de siste årene og laget en AI med det som grunnlag. Slik kunne hun liksom snakke med den døde vennen, som da ble en kunstig venn. Senere lagde hun en ny app, nemlig Replika, som tilbyr å være en kunstig venn.

Det virker som at inntektene ligger i erotikken og at Replika er skrudd sammen for å lokke brukerne til å bruke penger.

Barnevakten opprettet en konto og testet gratisversjonen av Replika, skjermbilder fra testen ser du her.

Tips til foreldre

- Snakk med barnet/tenåringen, på en positiv måte, om deres digitale liv. Snakk litt hver dag, det er bedre enn skippertak der alt skal på bordet. Ikke snakk kun om alt som er farlig og negativt, men snakk om hva som er gøy og også om dine egne digitale opplevelser. Spill gjerne med barna.

- Lag noen digitale husregler som kan justeres med barnets modenhet og alder. Skal barna følge aldersgrensene? Skal barna spørre deg før de laster ned apper og spill? Er det bestemte apper og spill de ikke skal benytte? Er det enkelte apper som er ok dersom du får justert foreldreinnstillingene? Hva med pengebruk?

- Si til barnet at det ikke skal fortelle hemmeligheter og private opplysninger til kunstige venner. De store AI-aktørene gir selv dette rådet.