Skole-AI og skole-søk er ikke nøytrale

En kunstig intelligens viste seg å være rasistisk, og en søkemotor favoriserer nettsteder som betaler mest. Skolens digitale hjelpemidler er ikke nøytrale og elevene blir naturlig nok påvirket.

Elever på barneskoler og ungdomsskoler må benytte mange digitale tjenester som søkemotor, nettleser, skriveprogram og mye annet. Nå begynner også samtalebasert kunstig intelligens å komme inn i skolene, Oslo kommune kjøpte nylig inn 92.000 elevlisenser fra Microsoft Azure OpenAI.

Med kunstig intelligens i skolene er det enda viktigere å diskutere hvilken påvirkning digitale tjenester gir. Et ferskt eksempel er AI-en Gemini fra Google som viste seg å være rasistisk mot hvite mennesker. Det resulterte også i misvisende AI-bilder fra verdenshistorien.

Dette ble oppdaget av brukerne. Så kan man lure på hva annet som utviklerne har lagt inn av koder og regler eller hva annet som selve teknologien fører til uten at det blir oppdaget.

Noen ganger kan man skylde på selve teknologien, for AI-er blir opplært av alt den leser på nettet, og på nettet finnes det for eksempel rasisme. Men med Gemini var det utviklerne selv som hadde lagt inn koder som sterkt begrenset AI-en i å lage bilder av folk som har lys hud.

Digitale tjenester ikke nøytrale tjenester

Den kunstige intelligensen ChatGPT vil gjerne at sykepleiere skal være kvinner og leger skal være menn når den svarer deg, det har Barnevakten selv testet. ChatGPT tar antagelig utgangspunkt i amerikansk statistikk. Seks av ti leger er menn. Ni av ti sykepleiere er kvinner.

Dermed kan man mene at AI-en rett og slett viser frem verden slik den er. Og det er da ikke så farlig? I tilfelle er det en amerikansk verden og ikke en norsk.

Påvirkningen kan være slik at man ikke legger merke til det. I en setning som er utydelig om det er sykepleieren eller legen som er gravid, kan det hende at AI-en forutsetter at det er sykepleieren som er gravid (se lenken over), for amerikansk statistikk sier at det det er få kvinnelige leger.

Med gode allmennkunnskaper er det lettere å avsløre at en AI ikke har gitt deg et nøytralt svar. Men elever på barneskolen har ikke gode allmennkunnskaper, man kan derfor diskutere om det er riktig at de utsettes daglig for AI-tjenester fra én bestemt digital aktør. En løsning er å spre påvirkningen ut på flere leverandører.

Et forslag om å spre risikoen, kommer kanskje ikke lenger enn nettsiden som du leser nå. For flere leverandører av kunstig intelligens, søkemotorer og digitale skoleløsninger koster mer penger i form av lisenser og opplæring av lærere. Men med kreativitet kan kanskje naboskoler bytte lisenser halvveis i løpet eller noe slikt.

Et viktig spørsmål før man leier inn digitale tjenester for elevene, er:

Skal søkemotorer, lærebøker og AI-er vise verden slik den er, eller slik vi ønsker at den skal være?

Skal søkemotoren vise frem bilder av menn når eleven ber om bilder av kriminelle, fordi menn er overrepresentert i fengslene? Eller skal den vise frem begge kjønn og mange etnisiteter?

Eksemplene med bilder er lette å se hvis man er litt bevisst. Det er vanskeligere å oppdage den «skjulte» påvirkningen i samtalene som eleven har med AI-en. Det kan handle om hvilke etiske regler som utviklerne har lagt inn i AI-ene eller om hvordan selve teknologien virker. Et eksempel: Da Barnevakten testet ChatGPT i 2023, var den villig til å lage vitser om enkelte religioner, men ikke om alle.

Her er et eksempel på forskning som forsøker å avdekke hvilke politiske verdier ChatGPT uttrykker. Det viser seg at ChatGPT står for ulike politiske syn etter hvilket språk spørsmålene stilles i.

Søkemotorer er ikke nøytrale

Søkemotorer er skrudd sammen av selskapene for å løfte frem bestemte søketreff. Dersom alle søkemotorene var helt nøytrale, ville de ha vist samme treff, men det gjør de ikke. I tillegg er søketreffene ofte basert på hva søkemotoren har samlet inn av opplysninger om brukeren, for eksempel at brukeren bor i Kristiansand.

Det er en del gode mål som utviklerne kan ha satt for en søkemotor. Man favoriserer for eksempel nettsteder som man antar har relevant innhold og som er raske å laste ned. I tillegg løfter man gjerne frem nettsteder som er enkle å navigere i og som har oppdatert innhold. Dette skjer automatisk med digitale roboter som farer over nettet og gjør analyser av hvert nettsted.

Spørsmålet er om utviklerne også manuelt legger inn politiske, etiske eller kommersielle føringer. I arbeidet med AI-er har utviklerne lagt inn etiske regler, og de er ulike fra selskap til selskap. Det kan hende at utviklerne av søkemotorer tenker på samme måte.

I USA diskuterer man om Google favoriserer den politiske venstresiden i sine søketreff. Det kan hende at venstresiden rett og slett er flinkere til å utføre såkalt søkemotoroptimalisering, det hevder i alle fall dette nettstedet. Søkemotoroptimalisering kalles SEO, det betyr for eksempel at man er flink til å legge inn gode søkeord i overskriftene.

En stort SEO-selskap kom frem til samme konklusjon, altså at Google ikke favoriserer venstresiden eller høyresiden, men at venstresiden kom høyere og oftere opp i treffene fordi venstresiden er flinkere til å indeksere nettsidene sine.

Og da er det i tilfelle ikke Googles utviklere som har kodet søkemotoren til å favorisere et bestemt politisk syn. Men likevel er ikke tjenesten nøytral å benytte for elever på en norsk skole.

For å si det enkelt: Selskapene som betaler Google mest, kommer øverst i treffene. Og de som er flinke til å tilpasse seg teknologien, kommer nest øverst. Man ender uansett opp med søketreff som ikke er helt nøytrale.

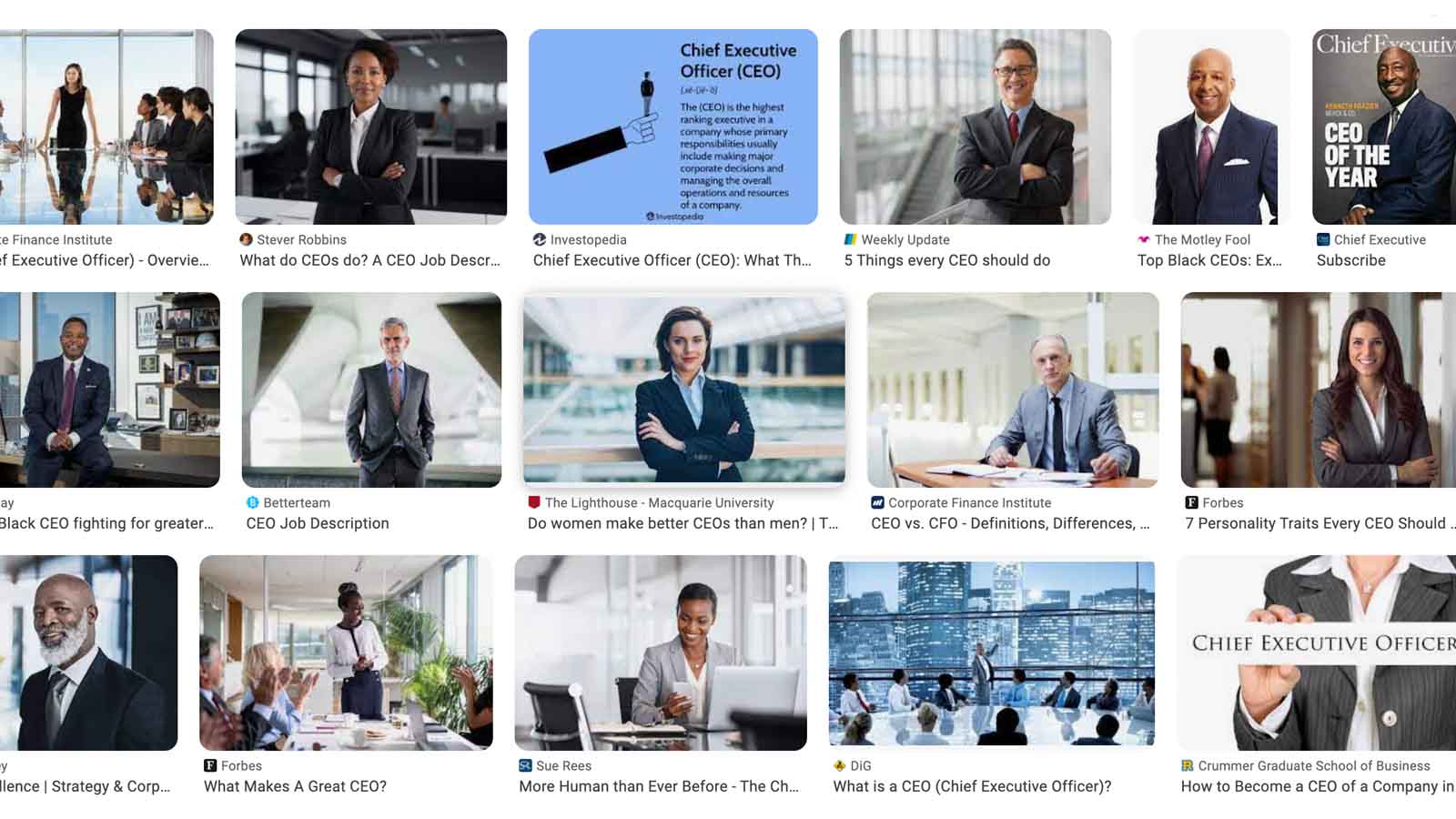

Googles søkemotor har tidligere fått kritikk for å kun vise hvite menn når man søker etter sjefer, nærmere bestemt «CEO». Tar du søket i dag, vises en hvit kvinne og en farget kvinne på de to første treffene, deretter en hvit mann etterfulgt av tre fargede menn, og så videre. Hvite menn er i mindretall blant de øverste treffene. Det er tydelig at Google manuelt har overstyrt tidligere koding.

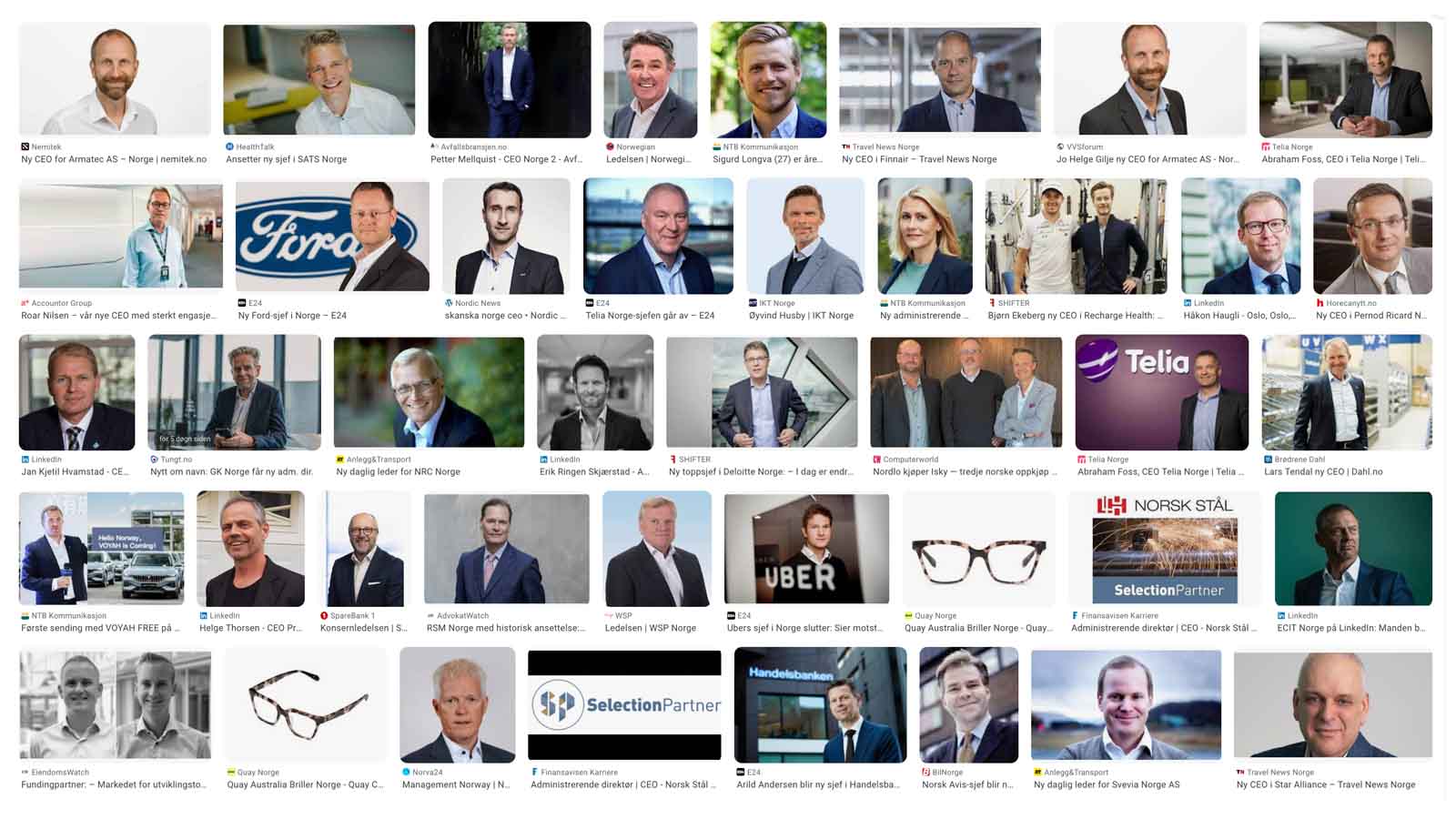

Men søker du CEO Norge, har ikke Google maktet å følge opp med lignende «ikke-diskriminerende» koder. De 40 første treffene viser hvite menn og én hvit kvinne:

Som sagt er det lett å se utslag av teknologi og koder når det gjelder bilder, hvis man bevisst ser etter slike tegn. Det er vanskeligere å oppdage om enkelte politiske synspunkter blir favorisert av teknologien.

Det finnes mange søkemotorer. Noen av disse har utviklere som arbeider ideelt og som ikke ønsker å spore deg eller vise deg reklame. Googles søkemotor er i den andre enden av skalaen og både sporer deg og pusher annonser. Man kan derfor spørre hvorfor en del skoler lærer elevene å bruke Google hver eneste dag.

Søkemotoren Duckduckgo skriver at den ikke gir partiske treff innen politikk. Men helt nøytral er det nok vanskelig å være, for noen valg må man ta for å løfte frem ti treff over hundretusener av nettsider.

Da Russland angrep Ukraina, valgte vestlige søkemotorer å sende russiske propagandasider nedover i søketreffene, og det samme gjorde Duckduckgo. Dermed fikk Duckduckgo kritikk av enkelte, fordi søkemotoren tok side i en konflikt.

Også ledetekstene og søkeordene påvirker

Ber du AI-en lage en vits om en mann som har én fot, kan den være villig til det. Skriver du at mannen har dessverre én fot, så kan det ene ordet gjøre at AI-en nekter å lage en vits. AI-ene påvirkes av hvilke ord du bruker i ledetekstene. Derfor krever det forskning for å finne ut av hvilken etikk eller hvilket politisk syn en AI har samlet sett.

Det er 244 kommuner i Norge som har færre enn 10.000 innbyggere, disse kommunene har neppe hver for seg forskningsressurser til å finne ut hvilket politisk syn de ulike AI-ene kan ha, før innkjøp til skolene. Men å lese gjennom en lærebok for å sjekke om den er partisk, det kan enhver lærer ha tid til. Søkemotorer og AI-er skiller seg altså ut som vanskelige å kvalitetssjekke før innkjøp.

Man kan si at det er viktig at elevene forstår hvordan ledetekster skal skrives. Men det er like viktig at kommunene forstår hvilke AI-er de ikke bør servere elevene. Søkemotorer og AI-er ikke en tilfeldig lærebok som brukes begrenset i skolen, men er kraftige verktøy som brukes i mange fag i mange år.

Vanskelig å bevise påvirkningen

Det er vanskelig å bevise at elevene blir påvirket av bestemte digitale tjenester over tid. Men på samme måte som barn får dialekt etter hvor de bor i landet, så ligger det i kortene at de også påvirkes av leverandørene som skolen ber dem benytte hver dag gjennom nesten hele skoleløpet.

Man kan se for seg minst fem forhold der elevene påvirkes:

- Kultur: Når elevene benytter AI fra Kina eller USA, ligger det innbakt en kultur i teknologien samt etikk som utviklerne har lagt inn. Det samme gjelder søkemotorer.

- Kommersielle vaner: Det kan hende at elevene ender opp som kunder hos Apple, Microsoft eller Google etter ti år fordi skolen har bestemt at det er en av disse leverandørene som elevene skal benytte. Du vet selv hvor lite motivert du er for bytte bank. Slik kan det også være når barnet ditt har brukt tjenestene fra én bestemt dataleverandør i ti år.

- Reklame: Når skolen ber elevene benytte en tjeneste som inneholder reklame, vil elevene naturlig nok bli påvirket av reklamen.

- Faktafeil: Kunstig intelligens inneholder som kjent faktafeil. Når en AI setter en terrorist på listen over norske helter, vil voksne se feilen ganske raskt. Barn har ikke nok livserfaring eller almennkunnskaper til å avsløre faktafeil i farten, og kan bli påvirket av feilene.

- Farlige forhold: AI-er og søkemotorer er ikke nødvendigvis utstyrt med barnefilter. Det kan dukke opp emner som er upassende for barn.

Barnevaktens forslag

- Lag nasjonale regler for digitale skoleløsninger.

- Opprett et nasjonalt tilsyn for barns bruk av kunstig intelligens.

- Ha pliktig kvalitetskontroll av AI-en før det kjøpes inn skolelisenser.

- Ikke la elevene benytte samme AI, samme nettleser, samme søketjeneste og samme digitale skoleløsning daglig gjennom hele skoleløpet. Bytt leverandør nå og da for å spre påvirkningen og risikoen.

(Hovedbilde helt øverst: Foto: Schutterstock / SeventyFour.)

Rettelse 23. mars 2024: I artikkelen sto det opprinnelig at Oslo kommune har kjøpt inn ChatGPT-lisenser fra OpenAI. 23. mars 2024 ble dette rettet til at lisensene gjelder den kunstige intelligensen Microsoft Azure OpenAI.